W szybko zmieniającym się krajobrazie programowania webowego, zapotrzebowanie na natychmiastowe dostarczanie danych przestało być jedynie opcjonalnym dodatkiem ("nice-to-have"), a stało się fundamentalnym wymogiem. Niezależnie od tego, czy jest to wspólna przestrzeń robocza AI, platforma do handlu wysokiej częstotliwości (high-frequency trading), czy wieloosobowe środowisko gamingowe, tradycyjny cykl żądanie-odpowiedź protokołu HTTP już nie wystarcza.

W miarę przechodzenia przez rok 2025 i wkraczania w 2026, ekosystem czasu rzeczywistego znacząco dojrzał. Wraz ze stabilizacją Node.js 22 LTS, pojawieniem się WebTransport oraz zdecydowanym zwrotem w stronę komunikacji opartej na danych binarnych, budowanie aplikacji czasu rzeczywistego wymaga głębszego zrozumienia zarówno leżącego u podstaw protokołu, jak i nowoczesnych wzorców architektonicznych używanych do ich skalowania.

Zrozumienie WebSockets: Protokół i zmiana w 2026 roku

WebSockets (RFC 6455) zapewniają pełno-dupleksowy (full-duplex), dwukierunkowy kanał komunikacji przez pojedyncze, długotrwałe połączenie TCP. W przeciwieństwie do HTTP, gdzie klient musi zainicjować każdą interakcję, WebSockets pozwalają serwerowi na przesyłanie danych do klienta w momencie wystąpienia zdarzenia.

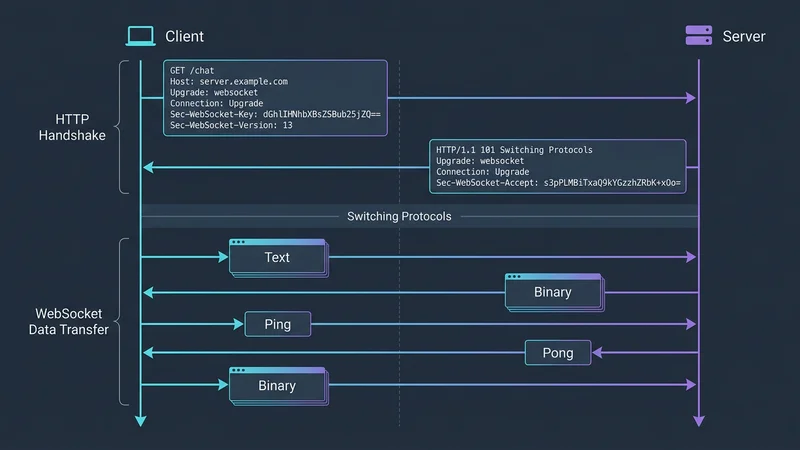

Mechanizm Handshake i Upgrade

Każde połączenie WebSocket zaczyna się jako standardowe żądanie HTTP/1.1. Jest to kluczowe dla kompatybilności z istniejącą infrastrukturą webową. Klient wysyła żądanie "Handshake" zawierające określone nagłówki:

GET /chat HTTP/1.1

Host: server.example.com

Upgrade: websocket

Connection: Upgrade

Sec-WebSocket-Key: dGhlIHNhbXBsZSBub25jZQ==

Sec-WebSocket-Version: 13Jeśli serwer obsługuje ten protokół, odpowiada statusem HTTP 101 Switching Protocols. W tym momencie połączenie HTTP zostaje "uaktualnione" (upgraded) do WebSocket, a gniazdo TCP pozostaje otwarte dla ciągłej wymiany danych.

Wzrost natywnego wsparcia w Node.js

Przez lata deweloperzy Node.js polegali głównie na bibliotece ws lub Socket.IO. Jednak wraz z wydaniem Node.js 22 LTS, środowisko uruchomieniowe zawiera teraz stabilną, wbudowaną implementację klienta WebSocket poprzez moduł node:ws. To dostosowanie do przeglądarkowego Web API redukuje nadmiar zależności i zapewnia, że kod napisany dla strony klienta może być często współdzielony lub odzwierciedlany po stronie serwera przy minimalnym wysiłku.

Komunikacja na poziomie ramek i Heartbeats

Dane w WebSockets są transmitowane w "ramkach" (frames). Mogą to być ramki tekstowe (UTF-8) lub ramki binarne. Aby utrzymać sprawność tych długotrwałych połączeń, protokół zawiera ramki kontrolne: Ping i Pong.

W 2026 roku najlepszą praktyką jest implementacja automatycznego mechanizmu "heartbeat". Ponieważ wiele zapór ogniowych (firewalls) i load balancerów zamyka bezczynne połączenia TCP, wysyłanie ramki Ping co 30–60 sekund zapewnia, że ścieżka pozostaje otwarta. Jeśli klient nie odpowie ramką Pong w określonym oknie czasowym, serwer powinien bezpiecznie zamknąć połączenie, aby zapobiec zużywaniu pamięci przez "gniazda-zombie".

Architektura i optymalizacja: Poza JSON

Choć JSON był lingua franca sieci przez ponad dekadę, wysokowydajne aplikacje czasu rzeczywistego w latach 2025–2026 zmierzają w stronę Serializacji Binarnej.

Przejście na protokoły Binary-First

JSON jest oparty na tekście, co ułatwia jego odczyt, ale sprawia, że jest kosztowny w parsowaniu i transmisji. W przypadku aplikacji takich jak pulpity finansowe na żywo czy telemetria IoT, narzut wynikający z powtarzania kluczy (np. "price": 100.50) w każdej wiadomości kumuluje się.

Nowocześni deweloperzy wybierają:

- Protocol Buffers (Protobuf): Opracowany przez Google, zapewnia silnie typowany schemat, który kompiluje się do wysoce skompresowanego formatu binarnego.

- MessagePack: Często opisywany jako "JSON, ale binarny", oferuje złoty środek ze znaczną redukcją rozmiaru bez wymagania ścisłej definicji schematu.

Używanie protokołów binarnych może zmniejszyć rozmiar ładunku (payload) nawet o 70% i znacząco obniżyć wykorzystanie procesora zarówno na serwerze, jak i u klienta, co jest krytyczne dla żywotności baterii urządzeń mobilnych.

WebSockets zoptymalizowane pod kątem Edge

Opóźnienie (latency) jest wrogiem doświadczeń w czasie rzeczywistym. W 2026 roku nie kończymy już wszystkich połączeń WebSocket w jednym scentralizowanym centrum danych. Zamiast tego używamy Edge-Optimized WebSockets.

Dzięki wdrażaniu handlerów WebSocket na krawędzi sieci (używając platform takich jak Cloudflare Workers lub Fly.io), początkowy handshake odbywa się w PoP (Point of Presence) najbliższym użytkownikowi. Skraca to "Time to Interactive" (TTI). Węzeł brzegowy utrzymuje następnie szybkie połączenie szkieletowe z główną bazą danych lub usługą synchronizacji stanu.

Obsługa Backpressure

Częstym trybem awarii w aplikacjach czasu rzeczywistego jest "wolny konsument". Jeśli serwer wysyła 100 wiadomości na sekundę, ale klient na połączeniu 3G może przetworzyć tylko 10, pamięć serwera w końcu zapełni się buforowanymi danymi.

Nowoczesne biblioteki, takie jak uWebSockets.js, zawierają teraz wbudowane zarządzanie backpressure. Deweloperzy mogą sprawdzić "ilość zbuforowanych danych" (buffered amount) na gnieździe przed wysłaniem kolejnych danych:

// Przykład obsługi backpressure w uWebSockets.js

ws.publish('updates', message, true); // Trzeci argument włącza kompresję

if (ws.getBufferedAmount() > 1024 * 1024) {

// Jeśli zbuforowano więcej niż 1MB, przestań wysyłać lub odrzuć nieistotne aktualizacje

console.warn('Klient ma opóźnienia. Porzucanie niekrytycznych ramek.');

}Skalowanie do milionów: Rozproszone systemy czasu rzeczywistego

WebSockets są stanowe (stateful). Sprawia to, że skalowanie poziome jest znacznie bardziej złożone niż skalowanie tradycyjnych API REST. Jeśli Użytkownik A jest połączony z Serwerem 1, a Użytkownik B z Serwerem 2, Serwer 1 nie ma natywnego sposobu na wysłanie wiadomości do Użytkownika B.

Skalowanie poziome z warstwą Pub/Sub

Aby to rozwiązać, używamy warstwy Pub/Sub (Publish/Subscribe). Gdy wiadomość musi zostać rozesłana, serwer obsługujący publikuje ją w centralnej magistrali (takiej jak Redis lub NATS). Wszystkie inne instancje serwerów subskrybują tę magistralę i przekazują wiadomość do swoich lokalnie połączonych klientów.

Sticky Sessions i Load Balancing

Używając load balancera (jak AWS ALB lub Nginx), musisz włączyć Cookie-based Session Affinity (Sticky Sessions). Zapewnia to, że podczas początkowego handshake'u HTTP i późniejszego upgrade'u, klient pozostaje skierowany do tej samej instancji serwera. Bez tego handshake mógłby trafić do Serwera A, ale próba upgrade'u do Serwera B, co skutkowałoby nieudanym połączeniem.

Zarządzanie stanem z Zustand

Po stronie klienta zarządzanie napływem danych w czasie rzeczywistym jest równie wymagające. W 2026 roku Zustand stał się preferowaną biblioteką do zarządzania stanem w aplikacjach czasu rzeczywistego opartych na React. Jego magazyn "poza Reactem" pozwala na aktualizację stanu bezpośrednio z callbacku WebSocket bez wywoływania niepotrzebnych ponownych renderowań całego drzewa komponentów.

import { create } from 'zustand';

interface PriceState {

prices: Record<string, number>;

updatePrice: (symbol: string, price: number) => void;

}

const usePriceStore = create<PriceState>((set) => ({

prices: {},

updatePrice: (symbol, price) =>

set((state) => ({ prices: { ...state.prices, [symbol]: price } })),

}));

// W twoim handlerze WebSocket

socket.onmessage = (event) => {

const { symbol, price } = JSON.parse(event.data);

usePriceStore.getState().updatePrice(symbol, price);

};Praktyczne przypadki użycia i implementacja

1. Współpracujący agenci AI

Eksplozja LLM stworzyła potrzebę strumieniowania tokenów. Gdy wielu użytkowników wchodzi w interakcję z agentem AI we wspólnej przestrzeni roboczej, WebSockets strumieniują generowany tekst znak po znaku do wszystkich uczestników jednocześnie, tworząc efekt "pisania na żywo".

2. Edycja współbieżna (CRDTs)

Nowoczesne wersje aplikacji takich jak Figma czy Google Docs używają Conflict-free Replicated Data Types (CRDTs). W przeciwieństwie do starszych metod "Operational Transformation" (OT), CRDT pozwalają użytkownikom edytować ten sam dokument offline lub online bez centralnej "blokady". WebSockets synchronizują aktualizacje typu delta między klientami, a logika CRDT zapewnia, że wszyscy klienci ostatecznie osiągną dokładnie ten sam stan.

3. Pulpity finansowe

W świecie handlu wysokiej częstotliwości milisekundy oznaczają miliony. WebSockets są używane do przesyłania aktualizacji "Order Book". Aby to zoptymalizować, deweloperzy często używają uWebSockets.js, który jest w stanie obsłużyć ponad milion jednoczesnych połączeń na pojedynczej instancji z dużą ilością pamięci, wykorzystując C++ pod maską.

Bezpieczeństwo i stabilność: Unikanie typowych pułapek

Bezpieczeństwo w WebSockets jest często pomijane, co prowadzi do poważnych podatności.

Cross-Site WebSocket Hijacking (CSWSH)

Ponieważ WebSockets nie przestrzegają Same-Origin Policy (SOP) w taki sam sposób jak HTTP, atakujący może zainicjować połączenie WebSocket ze złośliwej strony do twojego serwera.

Rozwiązanie: Zawsze waliduj nagłówek Origin podczas handshake'u. Jeśli pochodzenie nie zgadza się z twoimi dozwolonymi domenami, odrzuć połączenie statusem 403 Forbidden.

Wyczerpanie połączeń i Rate Limiting

Pojedynczy złośliwy aktor może otworzyć tysiące gniazd, wyczerpując deskryptory plików twojego serwera. Rozwiązanie:

- Zaimplementuj rate limiting oparty na IP na poziomie handshake'u.

- Ustaw maksymalną liczbę połączeń na identyfikator użytkownika.

- Użyj algorytmu "Leaky Bucket", aby ograniczyć liczbę wiadomości, które pojedyncze gniazdo może wysłać na sekundę.

Wycieki pamięci

W długo działających procesach Node.js nieusuwanie listenerów jest częstą przyczyną awarii.

// Bezpieczny wzorzec czyszczenia

const clients = new Set();

wss.on('connection', (ws) => {

clients.add(ws);

ws.on('close', () => {

clients.delete(ws); // Zapobieganie wyciekom pamięci

ws.terminate();

});

ws.on('error', (err) => {

console.error('Błąd gniazda:', err);

clients.delete(ws);

});

});Często zadawane pytania

Jaka jest różnica między WebSockets a long polling?

Long polling polega na tym, że klient wysyła żądanie HTTP, a serwer trzyma je otwarte do momentu pojawienia się nowych danych, po czym połączenie jest zamykane i proces się powtarza. WebSockets natomiast tworzą pojedyncze, trwałe połączenie TCP, które pozostaje otwarte dla dwukierunkowego przepływu danych, znacząco redukując narzut nagłówków i opóźnienia w porównaniu do ciągłego ponownego otwierania połączeń HTTP.

Kiedy używać WebSockets, a kiedy Server-Sent Events (SSE)?

Używaj WebSockets, gdy potrzebujesz dwukierunkowej komunikacji (np. czat, gry lub edycja współbieżna). Używaj Server-Sent Events (SSE), jeśli potrzebujesz tylko jednokierunkowego strumienia od serwera do klienta (np. kanał wiadomości lub pasek giełdowy), ponieważ SSE jest prostsze w implementacji, działa przez standardowe HTTP i ma wbudowane automatyczne ponowne łączenie.

Jak WebSockets obsługują komunikację w czasie rzeczywistym?

WebSockets obsługują komunikację w czasie rzeczywistym poprzez "uaktualnienie" standardowego połączenia HTTP do trwałego, pełno-dupleksowego gniazda TCP. Pozwala to na natychmiastowe przesyłanie danych w formie "ramek" w obu kierunkach bez narzutu nagłówków HTTP czy opóźnień związanych z ustanawianiem nowych połączeń dla każdej wiadomości.

Jak przeskalować aplikację WebSocket dla tysięcy użytkowników?

Aby skalować WebSockets, musisz użyć load balancera ze sticky sessions, aby zapewnić, że klienci pozostają połączeni z właściwą instancją serwera. Dodatkowo potrzebujesz magistrali Pub/Sub, takiej jak Redis lub NATS, aby rozsyłać wiadomości między wieloma rozproszonymi węzłami serwerów, umożliwiając komunikację użytkownikom na różnych serwerach.

Czy WebSockets są bardziej wydajne niż tradycyjne żądania HTTP?

Tak, w przypadku danych w czasie rzeczywistym WebSockets są znacznie wydajniejsze, ponieważ eliminują potrzebę wysyłania obszernych nagłówków HTTP z każdą wiadomością (które mogą mieć kilka KB). Po ustanowieniu połączenia narzut ramki wynosi tylko kilka bajtów, co drastycznie zmniejsza zużycie pasma i opóźnienia przy aktualizacjach o wysokiej częstotliwości.

Podsumowanie

Budowanie aplikacji czasu rzeczywistego z WebSockets w latach 2025–2026 wymaga zmiany myślenia z "prostego czatu" na "solidne strumieniowanie danych". Wykorzystując natywne możliwości Node.js 22, przyjmując protokoły binarne, takie jak Protobuf, i wdrażając rozwiązania na krawędzi sieci (Edge), możesz budować systemy, które są nie tylko szybkie, ale także wysoce skalowalne i bezpieczne.

Idąc naprzód, pamiętaj, że "stanowa" natura WebSockets jest twoim największym wyzwaniem. Priorytetowo traktuj czyste zarządzanie połączeniami, wdrażaj rygorystyczne nagłówki bezpieczeństwa i zawsze miej plan skalowania poziomego z użyciem magistrali Pub/Sub. Choć nowsze technologie, takie jak WebTransport (HTTP/3), zaczynają pojawiać się w specjalistycznych zastosowaniach, WebSockets pozostają najbardziej kompatybilnym i niezawodnym standardem dla doświadczeń webowych w czasie rzeczywistym.