L'evoluzione della containerizzazione: perché gli sviluppatori web non possono ignorare Docker e Kubernetes nel 2025

Il panorama dello sviluppo web è cambiato. Negli anni passati, la containerizzazione era spesso vista come "un problema del team DevOps". Tuttavia, mentre ci addentriamo nel 2025 e nel 2026, il confine tra la scrittura del codice e la gestione del suo ambiente di esecuzione è svanito. Con l'ascesa dei workflow integrati con l'IA, delle architetture micro-frontend e del Platform Engineering, Docker e Kubernetes sono diventati fondamentali nel kit di strumenti di uno sviluppatore web tanto quanto Git o TypeScript.

Le moderne applicazioni web non sono più solo una collezione di file statici o un singolo server monolitico. Sono ecosistemi complessi che coinvolgono LLM (Large Language Models) locali, database vettoriali e edge functions distribuite. Docker fornisce la coerenza necessaria per pacchettizzare questi diversi componenti, mentre Kubernetes offre l'orchestrazione per garantire che rimangano resilienti e scalabili.

Questa guida esplora lo stato attuale della containerizzazione, concentrandosi sulle ultime funzionalità di Docker 4.50+ e Kubernetes v1.33, e su come puoi sfruttarle per costruire applicazioni web più veloci e sicure.

Docker moderno: ottimizzare l'"Inner Loop"

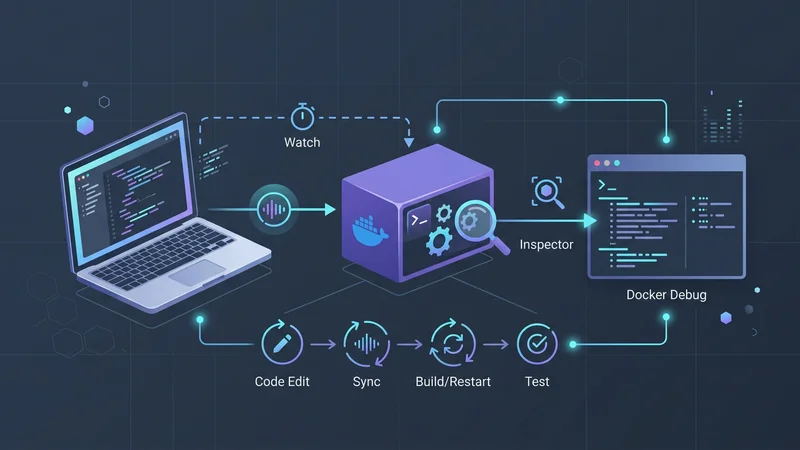

Per gli sviluppatori web, l'"inner loop" è il ciclo di codifica, testing e debugging. Storicamente, Docker aggiungeva attrito a questo processo: l'attesa del completamento delle build era un comune killer della produttività. Nel 2025, Docker ha puntato verso uno sviluppo a "zero attrito".

Docker Init e Docker Debug

Una delle aggiunte più significative è docker init. Invece di setacciare manualmente StackOverflow per trovare il Dockerfile perfetto per il tuo backend Next.js o Go, puoi semplicemente eseguire:

docker initQuesta utility scansiona il tuo progetto e genera file Dockerfile, .dockerignore e compose.yaml ottimizzati e su misura per il tuo framework specifico.

Inoltre, Docker Debug (introdotto nella versione 4.50+) risolve il dilemma delle "immagini slim". Gli sviluppatori utilizzano spesso immagini "distroless" o minimali per sicurezza, ma queste sono notoriamente difficili da debuggare perché prive di una shell. Docker Debug fornisce un set di strumenti integrato e indipendente dal linguaggio che si aggancia a qualsiasi container, anche quelli senza shell, permettendoti di ispezionare il filesystem e lo stato dei processi senza appesantire l'immagine di produzione.

Sviluppo in tempo reale con Compose Watch

I giorni dei docker-compose up --build manuali dopo ogni modifica al CSS sono finiti. La modalità "Watch" di Docker Compose consente una sincronizzazione in meno di un secondo tra il tuo codice sorgente locale e il container.

# compose.yaml

services:

web:

build: .

ports:

- "3000:3000"

develop:

watch:

- action: sync

path: ./src

target: /app/src

ignore:

- node_modules/

- action: rebuild

path: package.jsonCon questa configurazione, le modifiche alla tua directory src vengono sincronizzate istantaneamente nel container in esecuzione, mentre le modifiche a package.json attivano una ricostruzione automatica dell'immagine.

Kubernetes per sviluppatori web: oltre l'hype

Se Docker riguarda il packaging, Kubernetes (K8s) riguarda la sopravvivenza. Come sviluppatore web, non hai bisogno di essere un amministratore di cluster, ma devi capire come Kubernetes v1.32 ("Penelope") e v1.33 gestiscono il ciclo di vita della tua applicazione.

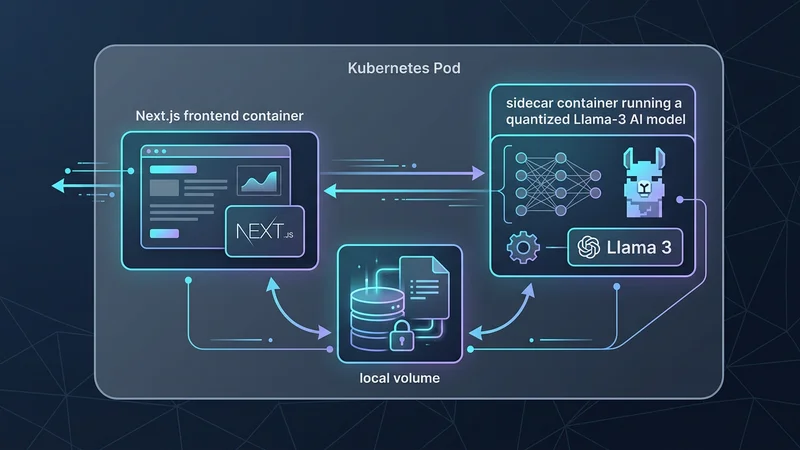

Sidecar Container nativi

Un importante punto critico in Kubernetes era il ciclo di vita dei sidecar container (ad esempio, agenti di logging o proxy di autenticazione). In precedenza, i sidecar potevano spegnersi prima che l'app principale finisse di elaborare una richiesta finale, portando alla perdita di dati. Nella v1.33, i Native Sidecar Containers hanno raggiunto la General Availability. Ora puoi definire un container come sidecar, assicurando che si avvii prima della tua app e si spenga dopo di essa, fornendo un'esperienza fluida per service mesh come Istio o Linkerd.

In-Place Pod Vertical Scaling

Tradizionalmente, cambiare i limiti di CPU o memoria di un Pod richiedeva un riavvio completo. Per un'app React/Node.js ad alto traffico, ciò significava un breve periodo di indisponibilità o la necessità di complessi rolling update. Il moderno Kubernetes ora supporta l'In-Place Pod Vertical Scaling. Puoi aggiornare le richieste/limiti di risorse al volo e il Kubelet regolerà le risorse del container senza terminare il processo: perfetto per gestire picchi improvvisi durante il lancio di un prodotto.

La Gateway API: il successore di Ingress

Per anni, l'Ingress API è stata lo standard per instradare il traffico esterno verso i servizi web. Tuttavia, era limitata e spesso richiedeva annotazioni specifiche del vendor. La Kubernetes Gateway API è ora lo standard. Fornisce un modo più espressivo e orientato ai ruoli per gestire il traffico, rendendo più facile per gli sviluppatori definire blue-green deployment o canary release direttamente nei propri manifesti.

Architettare Web App: Multi-Stage Builds e integrazione IA

Costruire immagini efficienti non è più opzionale. In un'era di cloud storage "pay-per-byte" e ambienti effimeri, la dimensione della tua immagine influisce direttamente sulla velocità e sul costo del deployment.

Multi-Stage Builds standardizzate

Per una moderna applicazione TypeScript/Node.js, una build multi-stage è il gold standard. Garantisce che la tua immagine di produzione finale contenga solo gli artefatti necessari, escludendo devDependencies e codice sorgente.

# Stage 1: Build

FROM node:22-alpine AS builder

WORKDIR /app

COPY package*.json ./

# Usa npm ci per build deterministiche in CI/CD

RUN npm ci

COPY . .

RUN npm run build

# Stage 2: Runtime

FROM node:22-alpine AS runner

# Imposta l'ambiente in produzione

ENV NODE_ENV=production

# Esegui come utente non-root per sicurezza

USER node

WORKDIR /app

# Copia solo l'output compilato e i moduli necessari

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/package.json ./package.json

EXPOSE 3000

CMD ["node", "dist/main.js"]Container AI-Native e DRA

Il trend più grande nel 2025 è l'integrazione di funzionalità IA direttamente nelle web app. Sia che tu stia eseguendo un LLM locale per la privacy dei dati o un database vettoriale per RAG (Retrieval-Augmented Generation), Kubernetes si è evoluto per supportare questi carichi di lavoro.

Il Dynamic Resource Allocation (DRA) consente a Kubernetes di gestire le GPU come risorse di prima classe. Gli sviluppatori web possono ora richiedere frazioni di GPU per compiti di inferenza all'interno delle specifiche dei loro Pod, similmente a come richiedono CPU o RAM.

Sicurezza e performance: evitare gli errori comuni

Man mano che la complessità degli ambienti containerizzati cresce, aumenta anche la superficie per gli errori. Di seguito sono riportati i problemi più comuni che gli sviluppatori web devono affrontare e le strategie per mitigarli.

| Errore | Conseguenza | Strategia di prevenzione |

|---|---|---|

COPY . . generico |

Segreti (come .env) o log locali trapelati nei layer dell'immagine. |

Usa un .dockerignore rigoroso e scansiona le immagini con Docker Scout. |

| Mancanza di limiti di risorse | Sindrome del "Noisy Neighbor"; un servizio consuma tutta la RAM del Nodo. | Definisci sempre resources: limits e requests nei manifesti K8s. |

Uso dei tag :latest |

Deployment non deterministici; impossibile eseguire il rollback in modo affidabile. | Usa il versionamento semantico (es. :v1.2.4) o i digest SHA. |

| Esecuzione come Root | Aumento del rischio di vulnerabilità da container escape. | Includi sempre USER node o un UID specifico nel tuo Dockerfile. |

| Ignorare i Probe | Traffico inviato a container ancora in fase di avvio o in crash. | Implementa livenessProbe e readinessProbe per ogni servizio. |

Implementazione dei Probe in Node.js

Un errore comune è trascurare la salute del container. Kubernetes deve sapere quando la tua app è pronta a ricevere traffico.

// Un semplice controllo di readiness in Express.js

app.get('/healthz/ready', (req, res) => {

// Controlla connessione DB, cache, ecc.

const isDbConnected = checkDbStatus();

if (isDbConnected) {

res.status(200).send('Ready');

} else {

res.status(503).send('Service Unavailable');

}

});Nel tuo manifesto Kubernetes:

readinessProbe:

httpGet:

path: /healthz/ready

port: 3000

initialDelaySeconds: 5

periodSeconds: 10Il panorama degli strumenti nel 2025

L'ecosistema intorno a Docker e Kubernetes è maturato, offrendo strumenti che rendono la gestione significativamente più semplice per gli sviluppatori.

- OrbStack: Per gli utenti macOS, OrbStack ha ampiamente sostituito Docker Desktop per molti grazie al suo overhead di CPU e memoria significativamente inferiore e ai tempi di avvio fulminei.

- Lens / OpenLens: Conosciuto come l'"IDE per Kubernetes", Lens fornisce un'interfaccia visiva per esplorare i cluster, visualizzare i log e persino aprire shell terminali nei pod senza dover ricordare complessi comandi

kubectl. - KEDA (Kubernetes Event-driven Autoscaling): Mentre K8s scala in base a CPU/RAM, KEDA ti permette di scalare i tuoi pod web in base a eventi a livello applicativo, come il numero di messaggi in una coda RabbitMQ o la latenza di una metrica Prometheus.

- Trivy: Questo è lo standard del settore per la sicurezza. Integra Trivy nella tua pipeline CI/CD per scansionare i tuoi Dockerfile e i YAML di Kubernetes alla ricerca di configurazioni errate e vulnerabilità prima che raggiungano la produzione.

Domande frequenti

È davvero necessario per gli sviluppatori web imparare Docker?

Sì, Docker è diventato lo standard del settore per garantire la coerenza dell'ambiente tra sviluppo, staging e produzione. Imparare Docker ti permette di pacchettizzare dipendenze e ambienti di runtime, eliminando completamente il problema del "funziona sulla mia macchina".

Qual è la differenza tra Docker e Kubernetes?

Docker è uno strumento utilizzato per creare, distribuire ed eseguire singoli container su un singolo host. Kubernetes è una piattaforma di orchestrazione che gestisce cluster di container, occupandosi di scalabilità, bilanciamento del carico e auto-riparazione su più macchine.

Dovrei imparare prima Docker o Kubernetes?

Dovresti assolutamente imparare prima Docker, poiché fornisce i blocchi fondamentali (i container) che Kubernetes gestisce. Capire come costruire ed eseguire un singolo container è un prerequisito per capire come orchestrarne centinaia in un cluster.

Posso usare Docker senza Kubernetes per piccoli progetti?

Assolutamente sì; per piccoli progetti o semplici app secondarie, Docker Compose o una "Platform as a Service" (PaaS) come Railway o Render è spesso sufficiente. Kubernetes è generalmente riservato ad applicazioni che richiedono alta disponibilità, scalabilità complessa o orchestrazione di microservizi.

In che modo Kubernetes migliora la scalabilità delle applicazioni web?

Kubernetes migliora la scalabilità attraverso funzionalità come l'Horizontal Pod Autoscaler (HPA), che aggiunge automaticamente più istanze della tua app in base al traffico. Gestisce anche il bilanciamento del carico e l'instradamento del traffico, assicurando che le nuove istanze inizino a ricevere richieste immediatamente senza configurazione manuale.

Conclusione

Nel 2025 e 2026, i ruoli di "Developer" e "Operator" continuano a fondersi nella disciplina del Platform Engineering. Per gli sviluppatori web, Docker e Kubernetes non sono più solo target di deployment; sono la tela su cui vengono costruite applicazioni moderne, resilienti e potenziate dall'IA.

Padroneggiando l'"inner loop" con strumenti come Docker Compose Watch e docker init, e comprendendo l'"outer loop" con i sidecar di Kubernetes e la Gateway API, ti posizioni all'avanguardia del settore. L'obiettivo non è solo scrivere codice che funzioni, è scrivere codice che scali, sopravviva e abbia successo in un mondo cloud-native. Inizia in piccolo, containerizza il tuo progetto attuale ed esplora gradualmente la potenza di orchestrazione che Kubernetes offre. Il futuro del web è containerizzato.