Nel panorama in rapida evoluzione dello sviluppo web, la richiesta di una consegna istantanea dei dati è passata da una funzionalità "accessoria" a un requisito fondamentale. Che si tratti di un workspace AI collaborativo, di una piattaforma di trading ad alta frequenza o di un ambiente di gioco multi-utente, il tradizionale ciclo richiesta-risposta di HTTP non è più sufficiente.

Mentre avanziamo nel 2025 e verso il 2026, l'ecosistema real-time è maturato significativamente. Con la stabilizzazione di Node.js 22 LTS, l'emergere di WebTransport e un deciso spostamento verso la comunicazione binary-first, la creazione di applicazioni real-time richiede una comprensione più profonda sia del protocollo sottostante che dei moderni pattern architetturali utilizzati per scalarli.

Comprendere i WebSocket: Il Protocollo e la Svolta del 2026

I WebSocket (RFC 6455) forniscono un canale di comunicazione full-duplex e bidirezionale su una singola connessione TCP a lunga durata. A differenza di HTTP, dove il client deve avviare ogni interazione, i WebSocket consentono al server di inviare dati al client nel momento stesso in cui si verifica un evento.

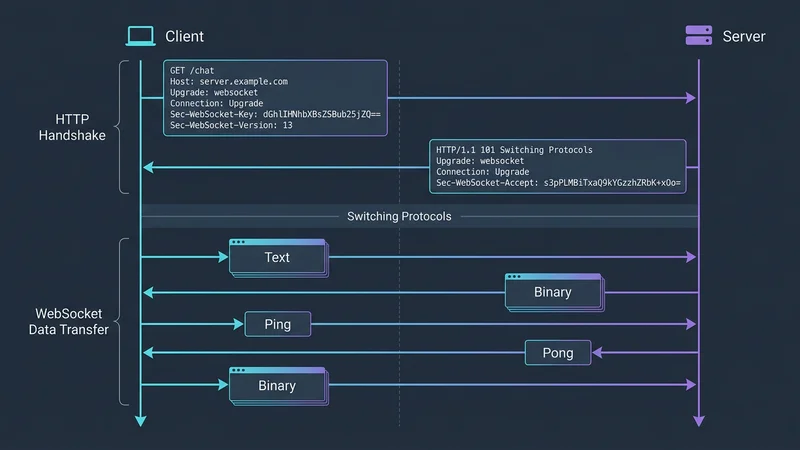

L'Handshake e il Meccanismo di Upgrade

Ogni connessione WebSocket inizia come una richiesta HTTP/1.1 standard. Questo è fondamentale per la compatibilità con l'infrastruttura web esistente. Il client invia una richiesta di "Handshake" contenente header specifici:

GET /chat HTTP/1.1

Host: server.example.com

Upgrade: websocket

Connection: Upgrade

Sec-WebSocket-Key: dGhlIHNhbXBsZSBub25jZQ==

Sec-WebSocket-Version: 13Se il server supporta il protocollo, risponde con uno stato HTTP 101 Switching Protocols. A questo punto, la connessione HTTP viene aggiornata ("upgraded") a WebSocket e il socket TCP rimane aperto per uno scambio continuo di dati.

L'Ascesa del Supporto Nativo in Node.js

Per anni, gli sviluppatori Node.js si sono affidati pesantemente alla libreria ws o a Socket.IO. Tuttavia, con il rilascio di Node.js 22 LTS, il runtime include ora un'implementazione client WebSocket integrata e stabile tramite il modulo node:ws. Questo allineamento con la Web API del browser riduce il gonfiore delle dipendenze e garantisce che il codice scritto per il lato client possa spesso essere condiviso o rispecchiato sul lato server con il minimo attrito.

Comunicazione a Livello di Frame e Heartbeat

I dati nei WebSocket vengono trasmessi in "frame". Questi possono essere frame di testo (UTF-8) o frame binari. Per mantenere lo stato di salute di queste connessioni a lunga durata, il protocollo include frame di controllo: Ping e Pong.

Nel 2026, la best practice consiste nell'implementare un meccanismo di "heartbeat" automatico. Poiché molti firewall e load balancer terminano le connessioni TCP inattive, l'invio di un frame di Ping ogni 30–60 secondi assicura che il percorso rimanga aperto. Se un client non risponde con un Pong entro una finestra specifica, il server dovrebbe chiudere correttamente la connessione per evitare che i socket "zombie" consumino memoria.

Architettura e Ottimizzazione: Oltre il JSON

Sebbene il JSON sia stato la lingua franca del web per oltre un decennio, le applicazioni real-time ad alte prestazioni nel 2025–2026 si stanno spostando verso la Serializzazione Binaria.

Passaggio ai Protocolli Binary-First

Il JSON è basato sul testo, il che lo rende facile da leggere ma costoso da analizzare e trasmettere. Per applicazioni come dashboard finanziarie live o telemetria IoT, l'overhead della ripetizione delle chiavi (es. "price": 100.50) in ogni messaggio si accumula rapidamente.

I moderni sviluppatori stanno optando per:

- Protocol Buffers (Protobuf): Sviluppato da Google, fornisce uno schema fortemente tipizzato che viene compilato in un formato binario altamente compresso.

- MessagePack: Spesso descritto come "JSON ma binario", offre una via di mezzo con riduzioni significative delle dimensioni senza richiedere una definizione rigorosa dello schema.

L'uso di protocolli binari può ridurre le dimensioni del payload fino al 70% e abbassare significativamente l'utilizzo della CPU sia sul server che sul client, il che è critico per la durata della batteria dei dispositivi mobili.

WebSocket Ottimizzati per l'Edge

La latenza è il nemico delle esperienze real-time. Nel 2026, non terminiamo più tutte le connessioni WebSocket in un unico data center centralizzato. Utilizziamo invece i WebSocket ottimizzati per l'Edge.

Distribuendo i gestori WebSocket all'edge (utilizzando piattaforme come Cloudflare Workers o Fly.io), l'handshake iniziale avviene in un PoP (Point of Presence) più vicino all'utente. Ciò riduce il "Time to Interactive" (TTI). Il nodo edge mantiene quindi una connessione backbone ad alta velocità verso il database primario o il servizio di sincronizzazione dello stato.

Gestione della Backpressure

Una modalità di guasto comune nelle app real-time è il "consumatore lento" (slow consumer). Se un server invia 100 messaggi al secondo, ma un client su una connessione 3G può elaborarne solo 10, la memoria del server finirà per riempirsi di dati bufferizzati.

Librerie moderne come uWebSockets.js ora includono una gestione integrata della backpressure. Gli sviluppatori possono controllare la "quantità bufferizzata" su un socket prima di inviare altri dati:

// Esempio di gestione della backpressure in uWebSockets.js

ws.publish('updates', message, true); // Il terzo argomento abilita la compressione

if (ws.getBufferedAmount() > 1024 * 1024) {

// Se è bufferizzato più di 1MB, smetti di inviare o scarta gli aggiornamenti non essenziali

console.warn('Il client è in ritardo. Scarto i frame non critici.');

}Scalare a Milioni: Sistemi Real-Time Distribuiti

I WebSocket sono stateful. Questo rende la scalabilità orizzontale significativamente più complessa rispetto alla scalabilità delle tradizionali API REST. Se l'Utente A è connesso al Server 1 e l'Utente B è connesso al Server 2, il Server 1 non ha un modo nativo per inviare un messaggio all'Utente B.

Scalabilità Orizzontale con Backplane Pub/Sub

Per risolvere questo problema, utilizziamo un livello Pub/Sub (Publish/Subscribe). Quando un messaggio deve essere trasmesso, il server di gestione lo pubblica su un backplane centrale (come Redis o NATS). Tutte le altre istanze del server si iscrivono a questo backplane e inoltrano il messaggio ai propri client connessi localmente.

Sticky Sessions e Load Balancing

Quando si utilizza un load balancer (come AWS ALB o Nginx), è necessario abilitare la Cookie-based Session Affinity (Sticky Sessions). Ciò garantisce che durante l'handshake HTTP iniziale e il successivo upgrade, il client rimanga indirizzato alla stessa istanza del server. Senza questo, l'handshake potrebbe colpire il Server A, ma il tentativo di upgrade potrebbe colpire il Server B, risultando in una connessione fallita.

Gestione dello Stato con Zustand

Sul lato client, gestire l'afflusso di dati real-time è altrettanto impegnativo. Nel 2026, Zustand è diventata la libreria di gestione dello stato preferita per le app real-time basate su React. Il suo store "esterno a React" consente di aggiornare lo stato direttamente da una callback WebSocket senza innescare re-render non necessari dell'intero albero dei componenti.

import { create } from 'zustand';

interface PriceState {

prices: Record<string, number>;

updatePrice: (symbol: string, price: number) => void;

}

const usePriceStore = create<PriceState>((set) => ({

prices: {},

updatePrice: (symbol, price) =>

set((state) => ({ prices: { ...state.prices, [symbol]: price } })),

}));

// Nel tuo gestore WebSocket

socket.onmessage = (event) => {

const { symbol, price } = JSON.parse(event.data);

usePriceStore.getState().updatePrice(symbol, price);

};Casi d'Uso del Mondo Reale e Implementazione

1. Agenti AI Collaborativi

L'esplosione degli LLM ha creato la necessità di streaming di token. Quando più utenti interagiscono con un agente AI in uno spazio di lavoro condiviso, i WebSocket trasmettono il testo generato carattere per carattere a tutti i partecipanti simultaneamente, creando un effetto di "scrittura dal vivo".

2. Editing Collaborativo (CRDT)

Le versioni moderne di app come Figma o Google Docs utilizzano i Conflict-free Replicated Data Types (CRDT). A differenza dei vecchi metodi di "Operational Transformation" (OT), i CRDT consentono agli utenti di modificare lo stesso documento offline o online senza un "blocco" centrale. I WebSocket sincronizzano gli aggiornamenti delta tra i client e la logica CRDT garantisce che tutti i client convergano infine sullo stesso identico stato.

3. Dashboard Finanziarie

Nel mondo del trading ad alta frequenza, i millisecondi valgono milioni. I WebSocket vengono utilizzati per inviare aggiornamenti dell'"Order Book". Per ottimizzare questo processo, gli sviluppatori spesso utilizzano uWebSockets.js, che è in grado di gestire oltre un milione di connessioni simultanee su una singola istanza ad alta memoria sfruttando il C++ sotto il cofano.

Sicurezza e Stabilità: Evitare le Trappole Comuni

La sicurezza nei WebSocket viene spesso trascurata, portando a vulnerabilità significative.

Cross-Site WebSocket Hijacking (CSWSH)

Poiché i WebSocket non seguono la Same-Origin Policy (SOP) nello stesso modo in cui fa HTTP, un aggressore può avviare una connessione WebSocket da un sito malevolo al tuo server.

Mitigazione: Convalida sempre l'header Origin durante l'handshake. Se l'origine non corrisponde ai tuoi domini consentiti, rifiuta la connessione con un 403 Forbidden.

Esaurimento delle Connessioni e Rate Limiting

Un singolo attore malintenzionato può aprire migliaia di socket, esaurendo i descrittori di file del server. Mitigazione:

- Implementa il rate limiting basato su IP a livello di handshake.

- Imposta un numero massimo di connessioni per ID utente.

- Usa un algoritmo "Leaky Bucket" per limitare il numero di messaggi che un singolo socket può inviare al secondo.

Perdite di Memoria (Memory Leaks)

Nei processi Node.js a lunga esecuzione, la mancata pulizia dei listener è una causa comune di crash.

// Il pattern di pulizia "Sicuro"

const clients = new Set();

wss.on('connection', (ws) => {

clients.add(ws);

ws.on('close', () => {

clients.delete(ws); // Previene memory leak

ws.terminate();

});

ws.on('error', (err) => {

console.error('Errore socket:', err);

clients.delete(ws);

});

});Domande Frequenti

Qual è la differenza tra WebSocket e long polling?

Il long polling prevede che il client effettui una richiesta HTTP e il server la mantenga aperta finché non sono disponibili nuovi dati, dopodiché la connessione si chiude e il processo si ripete. I WebSocket, al contrario, creano una singola connessione TCP persistente che rimane aperta per il flusso di dati bidirezionale, riducendo significativamente l'overhead degli header e la latenza rispetto alla costante riapertura delle connessioni HTTP.

Quando dovrei usare i WebSocket rispetto ai Server-Sent Events (SSE)?

Usa i WebSocket quando hai bisogno di una comunicazione bidirezionale (es. chat, gaming o editing collaborativo). Usa i Server-Sent Events (SSE) se hai bisogno solo di uno stream unidirezionale dal server al client (es. un feed di notizie o un ticker azionario), poiché l'SSE è più semplice da implementare, funziona su HTTP standard e ha la riconnessione automatica integrata.

In che modo i WebSocket gestiscono la comunicazione real-time?

I WebSocket gestiscono la comunicazione real-time "aggiornando" una connessione HTTP standard a un socket TCP persistente e full-duplex. Ciò consente di inviare istantaneamente i dati come "frame" in entrambe le direzioni senza l'overhead degli header HTTP o il ritardo dovuto allo stabilire nuove connessioni per ogni messaggio.

Come posso scalare un'applicazione WebSocket per migliaia di utenti?

Per scalare i WebSocket, è necessario utilizzare un load balancer con sessioni sticky per garantire che i client rimangano connessi alla giusta istanza del server. Inoltre, serve un backplane Pub/Sub come Redis o NATS per trasmettere messaggi tra più nodi server distribuiti, in modo che gli utenti su server diversi possano comunicare tra loro.

I WebSocket sono più efficienti delle tradizionali richieste HTTP?

Sì, per i dati real-time i WebSocket sono molto più efficienti perché eliminano la necessità di inviare pesanti header HTTP con ogni messaggio (che possono essere di diversi KB). Una volta stabilita la connessione, l'overhead del framing è di pochi byte, riducendo drasticamente la larghezza di banda e la latenza per gli aggiornamenti ad alta frequenza.

Conclusione

Sviluppare applicazioni real-time con i WebSocket nel 2025–2026 richiede un cambio di mentalità: dalla "semplice chat" al "robusto streaming di dati". Sfruttando le capacità native di Node.js 22, adottando protocolli binari come Protobuf e distribuendo all'Edge, puoi costruire sistemi che non sono solo veloci ma anche altamente scalabili e sicuri.

Mentre procedi, ricorda che la natura "stateful" dei WebSocket è la tua sfida più grande. Dai priorità a una gestione pulita delle connessioni, implementa header di sicurezza rigorosi e abbi sempre un piano per la scalabilità orizzontale utilizzando un backplane Pub/Sub. Sebbene nuove tecnologie come WebTransport (HTTP/3) stiano iniziando a emergere per casi d'uso specializzati, i WebSocket rimangono lo standard più compatibile e affidabile per le esperienze web real-time oggi.