Die Evolution der Containerisierung: Warum Web-Entwickler 2025 nicht an Docker und Kubernetes vorbeikommen

Die Landschaft der Web-Entwicklung hat sich grundlegend verändert. In den vergangenen Jahren wurde Containerisierung oft als „Problem des DevOps-Teams“ betrachtet. Doch während wir uns auf die Jahre 2025 und 2026 zubewegen, ist die Grenze zwischen dem Schreiben von Code und der Verwaltung seiner Ausführungsumgebung verschwunden. Mit dem Aufstieg von KI-integrierten Workflows, Mikro-Frontend-Architekturen und Platform Engineering sind Docker und Kubernetes für das Toolkit eines Web-Entwicklers ebenso grundlegend geworden wie Git oder TypeScript.

Moderne Web-Anwendungen sind nicht mehr nur eine Sammlung statischer Dateien oder ein einzelner monolithischer Server. Sie sind komplexe Ökosysteme, die lokale LLMs (Large Language Models), Vektordatenbanken und verteilte Edge-Functions umfassen. Docker bietet die Konsistenz, die erforderlich ist, um diese vielfältigen Komponenten zu verpacken, während Kubernetes die Orchestrierung übernimmt, um sicherzustellen, dass sie resilient und skalierbar bleiben.

Dieser Leitfaden untersucht den aktuellen Stand der Containerisierung mit Fokus auf die neuesten Funktionen in Docker 4.50+ und Kubernetes v1.33 und zeigt auf, wie Sie diese nutzen können, um schnellere und sicherere Web-Anwendungen zu erstellen.

Modernes Docker: Optimierung des „Inner Loop“

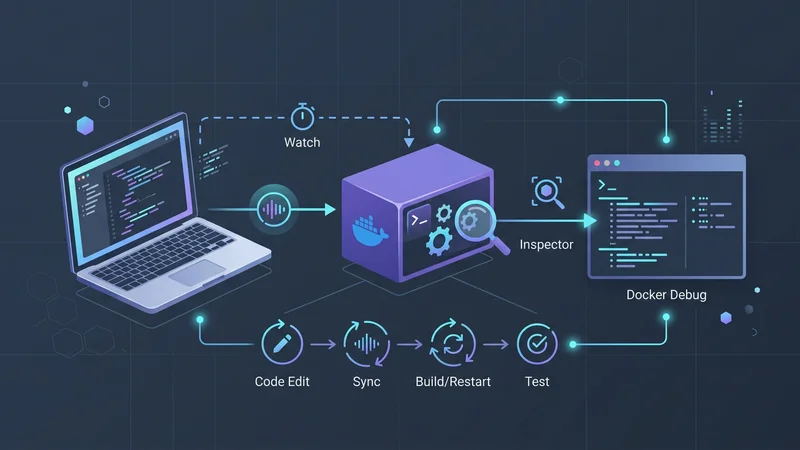

Für Web-Entwickler ist der „Inner Loop“ der Zyklus aus Codierung, Testen und Debugging. In der Vergangenheit verursachte Docker in diesem Prozess oft Reibungsverluste – das Warten auf den Abschluss von Builds war ein gängiger Produktivitätskiller. Im Jahr 2025 hat sich Docker in Richtung einer „Zero-Friction“-Entwicklung entwickelt.

Docker Init und Docker Debug

Eine der bedeutendsten Neuerungen ist docker init. Anstatt StackOverflow manuell nach dem perfekten Dockerfile für Ihr Next.js- oder Go-Backend zu durchsuchen, können Sie einfach Folgendes ausführen:

docker initDieses Tool scannt Ihr Projekt und erstellt optimierte Dockerfile-, .dockerignore- und compose.yaml-Dateien, die speziell auf Ihr Framework zugeschnitten sind.

Darüber hinaus löst Docker Debug (eingeführt in Version 4.50+) das Dilemma der „Slim Images“. Entwickler verwenden aus Sicherheitsgründen oft „distroless“ oder minimale Images, aber diese sind bekanntermaßen schwer zu debuggen, da ihnen eine Shell fehlt. Docker Debug bietet ein integriertes, sprachenunabhängiges Toolset, das sich an jeden Container anbindet – selbst an solche ohne Shell. Dies ermöglicht es Ihnen, das Dateisystem und den Prozessstatus zu inspizieren, ohne Ihr Production-Image aufzublähen.

Echtzeit-Entwicklung mit Compose Watch

Die Zeiten von manuellem docker-compose up --build nach jeder CSS-Änderung sind vorbei. Der Docker Compose „Watch“-Modus ermöglicht eine Synchronisierung zwischen Ihrem lokalen Quellcode und dem Container in unter einer Sekunde.

# compose.yaml

services:

web:

build: .

ports:

- "3000:3000"

develop:

watch:

- action: sync

path: ./src

target: /app/src

ignore:

- node_modules/

- action: rebuild

path: package.jsonMit dieser Konfiguration werden Änderungen in Ihrem src-Verzeichnis sofort mit dem laufenden Container synchronisiert, während Änderungen an der package.json einen automatischen Image-Rebuild auslösen.

Kubernetes für Web-Entwickler: Jenseits des Hypes

Wenn es bei Docker um das Verpacken geht, geht es bei Kubernetes (K8s) ums Überleben. Als Web-Entwickler müssen Sie kein Cluster-Administrator sein, aber Sie müssen verstehen, wie Kubernetes v1.32 („Penelope“) und v1.33 den Lebenszyklus Ihrer Anwendung verwalten.

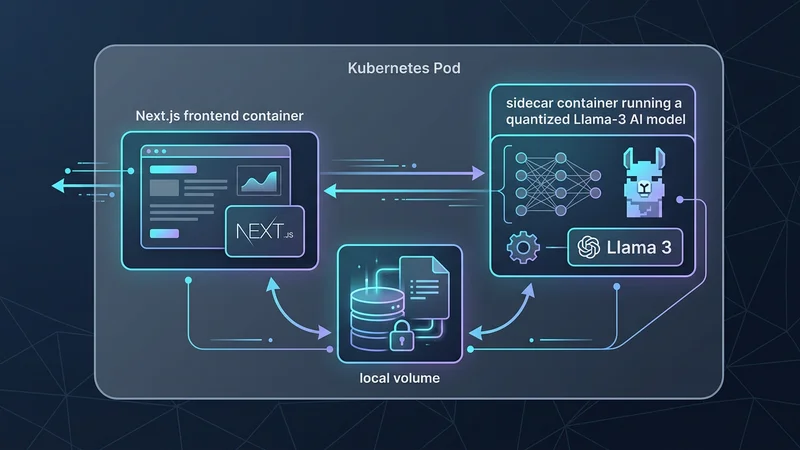

Native Sidecar-Container

Ein großer Schwachpunkt in Kubernetes war der Lebenszyklus von Sidecar-Containern (z. B. Logging-Agents oder Auth-Proxies). Bisher konnten Sidecars heruntergefahren werden, bevor die Hauptanwendung die Verarbeitung einer letzten Anfrage abgeschlossen hatte, was zu Datenverlust führte. In v1.33 haben Native Sidecar-Container die General Availability erreicht. Sie können nun einen Container als Sidecar definieren und so sicherstellen, dass er vor Ihrer App startet und nach Ihrer App herunterfährt. Dies bietet eine nahtlose Erfahrung für Service Meshes wie Istio oder Linkerd.

In-Place Pod Vertical Scaling

Traditionell erforderte das Ändern der CPU- oder Arbeitsspeicherlimits eines Pods einen vollständigen Neustart. Für eine hochfrequentierte React/Node.js-App bedeutete dies eine kurze Phase der Nichtverfügbarkeit oder die Notwendigkeit komplexer Rolling Updates. Modernes Kubernetes unterstützt jetzt In-Place Pod Vertical Scaling. Sie können Ressourcenanfragen/-limits im laufenden Betrieb aktualisieren, und das Kubelet passt die Ressourcen des Containers an, ohne den Prozess zu beenden – ideal, um plötzliche Lastspitzen während eines Produkt-Launches abzufangen.

Die Gateway API: Der Nachfolger von Ingress

Jahrelang war die Ingress API der Standard für das Routing von externem Traffic zu Web-Services. Sie war jedoch begrenzt und erforderte oft anbieterspezifische Annotationen. Die Kubernetes Gateway API ist nun der neue Standard. Sie bietet eine ausdrucksstärkere, rollenorientierte Art der Traffic-Verwaltung und macht es Entwicklern leichter, Blue-Green-Deployments oder Canary-Releases direkt in ihren Manifesten zu definieren.

Web-Apps architektonisch gestalten: Multi-Stage-Builds und KI-Integration

Das Erstellen effizienter Images ist nicht mehr optional. In einer Ära von „Pay-per-Byte“-Cloud-Speicher und kurzlebigen Umgebungen beeinflusst Ihre Image-Größe direkt die Deployment-Geschwindigkeit und die Kosten.

Standardisierte Multi-Stage-Builds

Für eine moderne TypeScript/Node.js-Anwendung ist ein Multi-Stage-Build der Goldstandard. Er stellt sicher, dass Ihr finales Production-Image nur die notwendigen Artefakte enthält und devDependencies sowie Quellcode ausschließt.

# Stage 1: Build

FROM node:22-alpine AS builder

WORKDIR /app

COPY package*.json ./

# npm ci für deterministische Builds in CI/CD verwenden

RUN npm ci

COPY . .

RUN npm run build

# Stage 2: Runtime

FROM node:22-alpine AS runner

# Umgebung auf Production setzen

ENV NODE_ENV=production

# Als non-root Benutzer ausführen (Sicherheit)

USER node

WORKDIR /app

# Nur den kompilierten Output und notwendige Module kopieren

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/package.json ./package.json

EXPOSE 3000

CMD ["node", "dist/main.js"]KI-native Container und DRA

Der größte Trend im Jahr 2025 ist die Integration von KI-Funktionen direkt in Web-Apps. Egal, ob Sie ein lokales LLM für den Datenschutz oder eine Vektordatenbank für RAG (Retrieval-Augmented Generation) betreiben, Kubernetes hat sich weiterentwickelt, um diese Workloads zu unterstützen.

Dynamic Resource Allocation (DRA) ermöglicht es Kubernetes, GPUs als „First-Class Citizens“ zu verwalten. Web-Entwickler können nun GPU-Bruchteile für Inference-Tasks innerhalb ihrer Pod-Spezifikationen anfordern, ähnlich wie sie CPU oder RAM anfordern.

Sicherheit und Performance: Häufige Stolperfallen vermeiden

Mit der zunehmenden Komplexität containerisierter Umgebungen wächst auch die Fehleranfälligkeit. Im Folgenden finden Sie die häufigsten Stolperfallen, mit denen Web-Entwickler konfrontiert sind, und Strategien, um diese zu entschärfen.

| Stolperfalle | Auswirkung | Vermeidungsstrategie |

|---|---|---|

Zu allgemeines COPY . . |

Secrets (wie .env) oder lokale Logs gelangen in Image-Layer. |

Nutzen Sie eine strikte .dockerignore und scannen Sie Images mit Docker Scout. |

| Fehlende Ressourcenlimits | „Noisy Neighbor“-Syndrom; ein Service verbraucht den gesamten Node-RAM. | Definieren Sie immer resources: limits und requests in K8s-Manifesten. |

Verwendung von :latest-Tags |

Nicht-deterministische Deployments; zuverlässige Rollbacks sind unmöglich. | Nutzen Sie Semantic Versioning (z. B. :v1.2.4) oder SHA-Digests. |

| Ausführung als Root | Erhöhtes Risiko von Container-Escape-Schwachstellen. | Fügen Sie immer USER node oder eine spezifische UID in Ihr Dockerfile ein. |

| Ignorieren von Probes | Traffic wird an Container gesendet, die noch booten oder abgestürzt sind. | Implementieren Sie livenessProbe und readinessProbe für jeden Service. |

Implementierung von Probes in Node.js

Ein häufiger Fehler ist das Vernachlässigen des Gesundheitszustands des Containers. Kubernetes muss wissen, wann Ihre App bereit ist, Traffic zu empfangen.

// Ein einfacher Express.js Readiness-Check

app.get('/healthz/ready', (req, res) => {

// DB-Verbindung, Cache etc. prüfen

const isDbConnected = checkDbStatus();

if (isDbConnected) {

res.status(200).send('Ready');

} else {

res.status(503).send('Service Unavailable');

}

});In Ihrem Kubernetes-Manifest:

readinessProbe:

httpGet:

path: /healthz/ready

port: 3000

initialDelaySeconds: 5

periodSeconds: 10Die Tooling-Landschaft 2025

Das Ökosystem rund um Docker und Kubernetes ist gereift und bietet Tools, die die Verwaltung für Entwickler erheblich erleichtern.

- OrbStack: Für macOS-Nutzer hat OrbStack Docker Desktop für viele weitgehend ersetzt, da es einen deutlich geringeren CPU- und Speicher-Overhead sowie blitzschnelle Startzeiten bietet.

- Lens / OpenLens: Bekannt als die „IDE für Kubernetes“, bietet Lens eine visuelle Oberfläche zum Erkunden von Clustern, Einsehen von Logs und sogar zum Öffnen von Terminal-Shells in Pods, ohne sich komplexe

kubectl-Befehle merken zu müssen. - KEDA (Kubernetes Event-driven Autoscaling): Während K8s basierend auf CPU/RAM skaliert, ermöglicht KEDA die Skalierung Ihrer Web-Pods basierend auf Anwendungsereignissen, wie der Anzahl der Nachrichten in einer RabbitMQ-Queue oder der Latenz einer Prometheus-Metrik.

- Trivy: Dies ist der Industriestandard für Sicherheit. Integrieren Sie Trivy in Ihre CI/CD-Pipeline, um Ihre Dockerfiles und Kubernetes-YAMLs auf Fehlkonfigurationen und Schwachstellen zu scannen, bevor sie die Produktion erreichen.

Häufig gestellte Fragen (FAQ)

Ist es für Web-Entwickler wirklich notwendig, Docker zu lernen?

Ja, Docker ist zum Industriestandard geworden, um Umgebungskonsistenz über Entwicklung, Staging und Produktion hinweg sicherzustellen. Das Erlernen von Docker ermöglicht es Ihnen, Abhängigkeiten und Laufzeitumgebungen zu verpacken, wodurch das „Auf meinem Rechner funktioniert es“-Problem vollständig eliminiert wird.

Was ist der Unterschied zwischen Docker und Kubernetes?

Docker ist ein Tool zum Erstellen, Verteilen und Ausführen einzelner Container auf einem einzelnen Host. Kubernetes ist eine Orchestrierungsplattform, die Cluster von Containern verwaltet und Skalierung, Load Balancing sowie Self-Healing über mehrere Maschinen hinweg übernimmt.

Sollte ich zuerst Docker oder Kubernetes lernen?

Sie sollten definitiv zuerst Docker lernen, da es die grundlegenden Bausteine (Container) bereitstellt, die Kubernetes verwaltet. Das Verständnis dafür, wie man einen einzelnen Container baut und ausführt, ist die Voraussetzung dafür, zu verstehen, wie man hunderte davon in einem Cluster orchestriert.

Kann ich Docker ohne Kubernetes für kleine Projekte verwenden?

Absolut. Für kleine Projekte oder einfache Side-Apps ist Docker Compose oder ein „Platform as a Service“ (PaaS) wie Railway oder Render oft völlig ausreichend. Kubernetes ist in der Regel Anwendungen vorbehalten, die hohe Verfügbarkeit, komplexe Skalierung oder Microservice-Orchestrierung erfordern.

Wie verbessert Kubernetes die Skalierbarkeit von Web-Anwendungen?

Kubernetes verbessert die Skalierbarkeit durch Funktionen wie den Horizontal Pod Autoscaler (HPA), der basierend auf dem Traffic automatisch weitere Instanzen Ihrer App hinzufügt. Es verwaltet auch das Load Balancing und Traffic-Routing, sodass neue Instanzen sofort Anfragen erhalten, ohne dass eine manuelle Konfiguration erforderlich ist.

Fazit

In den Jahren 2025 und 2026 verschmelzen die Rollen von „Entwickler“ und „Operator“ weiter zur Disziplin des Platform Engineering. Für Web-Entwickler sind Docker und Kubernetes nicht mehr nur Deployment-Ziele; sie sind die Leinwand, auf der moderne, resiliente und KI-gestützte Anwendungen entstehen.

Indem Sie den „Inner Loop“ mit Tools wie Docker Compose Watch und docker init meistern und den „Outer Loop“ mit Kubernetes Sidecars und der Gateway API verstehen, positionieren Sie sich an der Spitze der Branche. Das Ziel ist nicht nur, Code zu schreiben, der läuft – sondern Code zu schreiben, der in einer Cloud-Native-Welt skaliert, überlebt und erfolgreich ist. Fangen Sie klein an, containerisieren Sie Ihr aktuelles Projekt und erkunden Sie schrittweise die Orchestrierungskraft, die Kubernetes bietet. Die Zukunft des Webs ist containerisiert.