In der sich schnell entwickelnden Landschaft der Webentwicklung hat sich die Nachfrage nach sofortiger Datenbereitstellung von einem "Nice-to-have"-Feature zu einer Grundvoraussetzung gewandelt. Ob es sich um einen kollaborativen KI-Workspace, eine High-Frequency-Trading-Plattform oder eine Multi-User-Gaming-Umgebung handelt – der traditionelle Request-Response-Zyklus von HTTP reicht nicht mehr aus.

Während wir uns durch das Jahr 2025 und in das Jahr 2026 bewegen, hat sich das Echtzeit-Ökosystem erheblich weiterentwickelt. Mit der Stabilisierung von Node.js 22 LTS, dem Aufkommen von WebTransport und einer entscheidenden Verschiebung hin zur Binary-First-Kommunikation erfordert der Bau von Echtzeitanwendungen ein tieferes Verständnis sowohl des zugrunde liegenden Protokolls als auch der modernen Architekturmuster, die zu deren Skalierung verwendet werden.

WebSockets verstehen: Das Protokoll und der Wandel im Jahr 2026

WebSockets (RFC 6455) bieten einen Full-Duplex, bidirektionalen Kommunikationskanal über eine einzige, langlebige TCP-Verbindung. Im Gegensatz zu HTTP, bei dem der Client jede Interaktion initiieren muss, ermöglichen WebSockets dem Server, Daten in dem Moment an den Client zu "pushen", in dem ein Ereignis eintritt.

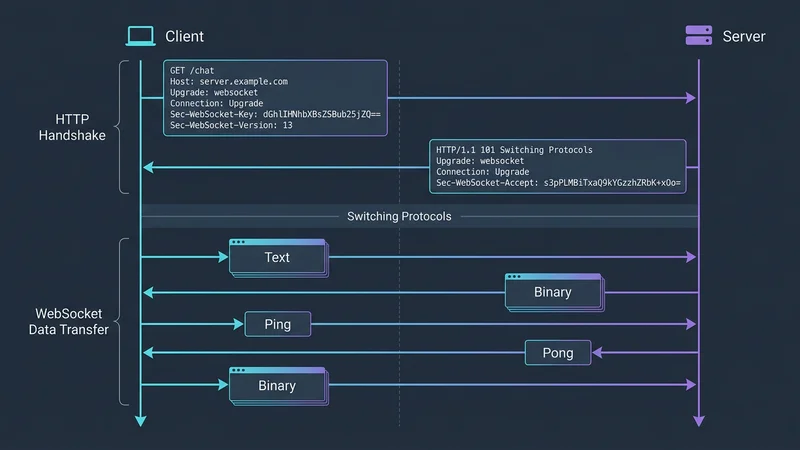

Der Handshake- und Upgrade-Mechanismus

Jede WebSocket-Verbindung beginnt als Standard-HTTP/1.1-Anfrage. Dies ist entscheidend für die Kompatibilität mit der bestehenden Web-Infrastruktur. Der Client sendet eine "Handshake"-Anfrage mit spezifischen Headern:

GET /chat HTTP/1.1

Host: server.example.com

Upgrade: websocket

Connection: Upgrade

Sec-WebSocket-Key: dGhlIHNhbXBsZSBub25jZQ==

Sec-WebSocket-Version: 13Wenn der Server das Protokoll unterstützt, antwortet er mit dem Status HTTP 101 Switching Protocols. An diesem Punkt wird die HTTP-Verbindung auf einen WebSocket "upgegradet", und der TCP-Socket bleibt für den kontinuierlichen Datenaustausch offen.

Der Aufstieg der nativen Node.js-Unterstützung

Jahrelang verließen sich Node.js-Entwickler stark auf die ws-Bibliothek oder Socket.IO. Mit der Veröffentlichung von Node.js 22 LTS enthält die Runtime nun jedoch eine stabile, integrierte WebSocket-Client-Implementierung über das Modul node:ws. Diese Angleichung an die Web-API des Browsers reduziert den Dependency-Overhead und stellt sicher, dass Code, der für die Client-Seite geschrieben wurde, oft mit minimalem Aufwand auf der Server-Seite geteilt oder gespiegelt werden kann.

Kommunikation auf Frame-Ebene und Heartbeats

Daten in WebSockets werden in "Frames" übertragen. Dies können Text-Frames (UTF-8) oder binäre Frames sein. Um den Zustand dieser langlebigen Verbindungen aufrechtzuerhalten, enthält das Protokoll Control-Frames: Ping und Pong.

Im Jahr 2026 ist es Best Practice, einen automatisierten "Heartbeat"-Mechanismus zu implementieren. Da viele Firewalls und Load Balancer inaktive TCP-Verbindungen beenden, stellt das Senden eines Ping-Frames alle 30–60 Sekunden sicher, dass der Pfad offen bleibt. Wenn ein Client nicht innerhalb eines bestimmten Zeitfensters mit einem Pong antwortet, sollte der Server die Verbindung ordnungsgemäß schließen, um zu verhindern, dass "Zombie"-Sockets Speicher verbrauchen.

Architektur und Optimierung: Jenseits von JSON

Obwohl JSON seit über einem Jahrzehnt die Lingua Franca des Webs ist, bewegen sich hochperformante Echtzeitanwendungen in den Jahren 2025–2026 hin zur binären Serialisierung.

Umstellung auf Binary-First-Protokolle

JSON ist textbasiert, was es leicht lesbar, aber teuer in der Analyse und Übertragung macht. Für Anwendungen wie Live-Finanz-Dashboards oder IoT-Telemetrie summiert sich der Overhead durch das Wiederholen von Schlüsseln (z. B. "price": 100.50) in jeder Nachricht.

Moderne Entwickler entscheiden sich für:

- Protocol Buffers (Protobuf): Von Google entwickelt, bietet dies ein streng typisiertes Schema, das in ein hochkomprimiertes Binärformat kompiliert wird.

- MessagePack: Oft als "JSON, aber binär" beschrieben, bietet es einen Mittelweg mit erheblichen Größenreduzierungen, ohne eine strikte Schemadefinition zu erfordern.

Die Verwendung binärer Protokolle kann die Payload-Größen um bis zu 70 % reduzieren und die CPU-Auslastung sowohl auf dem Server als auch auf dem Client erheblich senken, was für die Akkulaufzeit mobiler Geräte entscheidend ist.

Edge-optimierte WebSockets

Latenz ist der Feind von Echtzeit-Erlebnissen. Im Jahr 2026 terminieren wir nicht mehr alle WebSocket-Verbindungen in einem einzigen zentralen Rechenzentrum. Stattdessen nutzen wir Edge-optimierte WebSockets.

Durch das Deployment von WebSocket-Handlern an der Edge (unter Verwendung von Plattformen wie Cloudflare Workers oder Fly.io) findet der initiale Handshake an einem PoP (Point of Presence) statt, der dem Benutzer am nächsten liegt. Dies reduziert die "Time to Interactive" (TTI). Der Edge-Knoten unterhält dann eine Hochgeschwindigkeits-Backbone-Verbindung zu Ihrer primären Datenbank oder Ihrem State-Syncing-Dienst.

Umgang mit Backpressure

Ein häufiger Fehlermodus in Echtzeit-Apps ist ein "langsamer Konsument". Wenn ein Server 100 Nachrichten pro Sekunde pusht, ein Client mit einer 3G-Verbindung aber nur 10 verarbeiten kann, füllt sich der Speicher des Servers schließlich mit gepufferten Daten.

Moderne Bibliotheken wie uWebSockets.js verfügen heute über ein integriertes Backpressure-Management. Entwickler können die "buffered amount" eines Sockets prüfen, bevor sie weitere Daten senden:

// Beispiel für Backpressure-Handling in uWebSockets.js

ws.publish('updates', message, true); // Das dritte Argument aktiviert die Komprimierung

if (ws.getBufferedAmount() > 1024 * 1024) {

// Wenn mehr als 1MB gepuffert ist, Senden stoppen oder unkritische Updates verwerfen

console.warn('Client hinkt hinterher. Nicht kritische Frames werden verworfen.');

}Skalierung auf Millionen: Verteilte Echtzeitsysteme

WebSockets sind stateful (zustandsbehaftet). Dies macht die horizontale Skalierung deutlich komplexer als die Skalierung traditioneller REST-APIs. Wenn Benutzer A mit Server 1 verbunden ist und Benutzer B mit Server 2, hat Server 1 keine native Möglichkeit, eine Nachricht an Benutzer B zu senden.

Horizontale Skalierung mit Pub/Sub-Backplanes

Um dies zu lösen, verwenden wir einen Pub/Sub (Publish/Subscribe) Layer. Wenn eine Nachricht übertragen werden muss, veröffentlicht der verarbeitende Server diese auf einer zentralen Backplane (wie Redis oder NATS). Alle anderen Server-Instanzen abonnieren diese Backplane und leiten die Nachricht an ihre lokal verbundenen Clients weiter.

Sticky Sessions und Load Balancing

Wenn Sie einen Load Balancer verwenden (wie AWS ALB oder Nginx), müssen Sie Cookie-based Session Affinity (Sticky Sessions) aktivieren. Dies stellt sicher, dass der Client während des initialen HTTP-Handshakes und des anschließenden Upgrades an dieselbe Server-Instanz geleitet wird. Ohne dies könnte der Handshake Server A erreichen, der Upgrade-Versuch jedoch Server B, was zu einer fehlgeschlagenen Verbindung führt.

State Management mit Zustand

Auf der Client-Seite ist die Verwaltung der einströmenden Echtzeitdaten ebenso anspruchsvoll. Im Jahr 2026 ist Zustand zur bevorzugten State-Management-Bibliothek für React-basierte Echtzeit-Apps geworden. Sein "Outside-of-React"-Store ermöglicht es Ihnen, den Zustand direkt aus einem WebSocket-Callback heraus zu aktualisieren, ohne unnötige Re-Renders des gesamten Komponentenbaums auszulösen.

import { create } from 'zustand';

interface PriceState {

prices: Record<string, number>;

updatePrice: (symbol: string, price: number) => void;

}

const usePriceStore = create<PriceState>((set) => ({

prices: {},

updatePrice: (symbol, price) =>

set((state) => ({ prices: { ...state.prices, [symbol]: price } })),

}));

// In Ihrem WebSocket-Handler

socket.onmessage = (event) => {

const { symbol, price } = JSON.parse(event.data);

usePriceStore.getState().updatePrice(symbol, price);

};Praxisnahe Anwendungsfälle & Implementierung

1. Kollaborative KI-Agenten

Die Explosion von LLMs hat den Bedarf an Streaming-Tokens geweckt. Wenn mehrere Benutzer mit einem KI-Agenten in einem gemeinsamen Workspace interagieren, streamen WebSockets den generierten Text Zeichen für Zeichen an alle Teilnehmer gleichzeitig, wodurch ein "Live-Typing"-Effekt entsteht.

2. Kollaboratives Editieren (CRDTs)

Moderne Versionen von Apps wie Figma oder Google Docs verwenden Conflict-free Replicated Data Types (CRDTs). Im Gegensatz zu älteren "Operational Transformation" (OT)-Methoden ermöglichen CRDTs es Benutzern, dasselbe Dokument offline oder online zu bearbeiten, ohne einen zentralen "Lock". WebSockets synchronisieren die Delta-Updates zwischen den Clients, und die CRDT-Logik stellt sicher, dass alle Clients schließlich auf exakt denselben Zustand konvergieren.

3. Finanz-Dashboards

In der Welt des Hochfrequenzhandels bedeuten Millisekunden Millionen. WebSockets werden verwendet, um "Order Book"-Updates zu pushen. Um dies zu optimieren, verwenden Entwickler oft uWebSockets.js, das in der Lage ist, über eine Million gleichzeitige Verbindungen auf einer einzigen High-Memory-Instanz zu verarbeiten, indem es unter der Haube C++ nutzt.

Sicherheit und Stabilität: Häufige Fallstricke vermeiden

Die Sicherheit bei WebSockets wird oft übersehen, was zu erheblichen Schwachstellen führen kann.

Cross-Site WebSocket Hijacking (CSWSH)

Da WebSockets nicht der Same-Origin Policy (SOP) in der gleichen Weise wie HTTP folgen, kann ein Angreifer eine WebSocket-Verbindung von einer bösartigen Website zu Ihrem Server initiieren.

Abhilfe: Validieren Sie während des Handshakes immer den Origin-Header. Wenn der Origin nicht mit Ihren erlaubten Domains übereinstimmt, lehnen Sie die Verbindung mit 403 Forbidden ab.

Connection Exhaustion und Rate Limiting

Ein einzelner bösartiger Akteur kann Tausende von Sockets öffnen und die File-Deskriptoren Ihres Servers erschöpfen. Abhilfe:

- Implementieren Sie IP-basiertes Rate Limiting auf Handshake-Ebene.

- Legen Sie eine maximale Anzahl von Verbindungen pro User-ID fest.

- Verwenden Sie einen "Leaky Bucket"-Algorithmus, um die Anzahl der Nachrichten zu begrenzen, die ein einzelner Socket pro Sekunde senden kann.

Memory Leaks

In lang laufenden Node.js-Prozessen ist das Versäumnis, Listener zu bereinigen, eine häufige Ursache für Abstürze.

// Das "sichere" Cleanup-Muster

const clients = new Set();

wss.on('connection', (ws) => {

clients.add(ws);

ws.on('close', () => {

clients.delete(ws); // Memory Leaks verhindern

ws.terminate();

});

ws.on('error', (err) => {

console.error('Socket-Fehler:', err);

clients.delete(ws);

});

});Häufig gestellte Fragen (FAQ)

Was ist der Unterschied zwischen WebSockets und Long Polling?

Beim Long Polling stellt der Client eine HTTP-Anfrage, und der Server hält diese offen, bis neue Daten verfügbar sind. Danach wird die Verbindung geschlossen und der Prozess wiederholt sich. WebSockets hingegen erstellen eine einzige persistente TCP-Verbindung, die für den bidirektionalen Datenfluss offen bleibt, was den Header-Overhead und die Latenz im Vergleich zum ständigen Neuöffnen von HTTP-Verbindungen erheblich reduziert.

Wann sollte man WebSockets gegenüber Server-Sent Events (SSE) bevorzugen?

Verwenden Sie WebSockets, wenn Sie bidirektionale Kommunikation benötigen (z. B. Chat, Gaming oder kollaboratives Editieren). Verwenden Sie Server-Sent Events (SSE), wenn Sie nur einen unidirektionalen Stream vom Server zum Client benötigen (z. B. einen News-Feed oder Aktien-Ticker), da SSE einfacher zu implementieren ist, über Standard-HTTP funktioniert und eine automatische Wiederverbindung integriert hat.

Wie handhaben WebSockets die Echtzeitkommunikation?

WebSockets handhaben Echtzeitkommunikation, indem sie eine Standard-HTTP-Verbindung zu einem persistenten Full-Duplex-TCP-Socket "upgraden". Dies ermöglicht es, Daten sofort als "Frames" in beide Richtungen zu senden, ohne den Overhead von HTTP-Headern oder die Verzögerung durch den Aufbau neuer Verbindungen für jede Nachricht.

Wie skaliere ich eine WebSocket-Anwendung für Tausende von Benutzern?

Um WebSockets zu skalieren, müssen Sie einen Load Balancer mit Sticky Sessions verwenden, um sicherzustellen, dass Clients mit der richtigen Server-Instanz verbunden bleiben. Zusätzlich benötigen Sie eine Pub/Sub-Backplane wie Redis oder NATS, um Nachrichten über mehrere verteilte Serverknoten hinweg zu übertragen, damit Benutzer auf verschiedenen Servern miteinander kommunizieren können.

Sind WebSockets effizienter als traditionelle HTTP-Anfragen?

Ja, für Echtzeitdaten sind WebSockets viel effizienter, da sie die Notwendigkeit eliminieren, bei jeder Nachricht sperrige HTTP-Header (die mehrere KB groß sein können) zu senden. Sobald die Verbindung hergestellt ist, beträgt der Framing-Overhead nur wenige Bytes, was die Bandbreite und Latenz für hochfrequente Updates drastisch reduziert.

Fazit

Der Bau von Echtzeitanwendungen mit WebSockets in den Jahren 2025–2026 erfordert ein Umdenken von "einfachem Chat" hin zu "robustem Daten-Streaming". Durch die Nutzung der nativen Funktionen von Node.js 22, den Einsatz binärer Protokolle wie Protobuf und das Deployment an der Edge können Sie Systeme bauen, die nicht nur schnell, sondern auch hochskalierbar und sicher sind.

Denken Sie bei Ihren nächsten Schritten daran, dass die "stateful" Natur von WebSockets Ihre größte Herausforderung ist. Priorisieren Sie ein sauberes Verbindungsmanagement, implementieren Sie strikte Sicherheitsheader und planen Sie die horizontale Skalierung immer mit einer Pub/Sub-Backplane. Während neuere Technologien wie WebTransport (HTTP/3) für spezialisierte Anwendungsfälle auftauchen, bleiben WebSockets der kompatibelste und zuverlässigste Standard für heutige Echtzeit-Web-Erlebnisse.