Evoluția containerizării: De ce dezvoltatorii web nu pot ignora Docker și Kubernetes în 2025

Peisajul dezvoltării web s-a schimbat. În anii precedenți, containerizarea era adesea văzută ca „problema echipei de DevOps”. Cu toate acestea, pe măsură ce avansăm în 2025 și 2026, granița dintre scrierea codului și gestionarea mediului său de execuție s-a evaporat. Odată cu ascensiunea fluxurilor de lucru integrate cu AI, a arhitecturilor micro-frontend și a Platform Engineering, Docker și Kubernetes au devenit la fel de fundamentale pentru setul de instrumente al unui dezvoltator web ca Git sau TypeScript.

Aplicațiile web moderne nu mai sunt doar o colecție de fișiere statice sau un singur server monolitic. Ele sunt ecosisteme complexe care implică LLM-uri (Large Language Models) locale, baze de date vectoriale și funcții edge distribuite. Docker oferă consecvența necesară pentru a împacheta aceste componente diverse, în timp ce Kubernetes oferă orchestrarea necesară pentru a asigura că acestea rămân reziliente și scalabile.

Acest ghid explorează starea actuală a containerizării, concentrându-se pe cele mai recente caracteristici din Docker 4.50+ și Kubernetes v1.33 și pe modul în care le poți valorifica pentru a construi aplicații web mai rapide și mai sigure.

Docker modern: Eficientizarea „Inner Loop”-ului

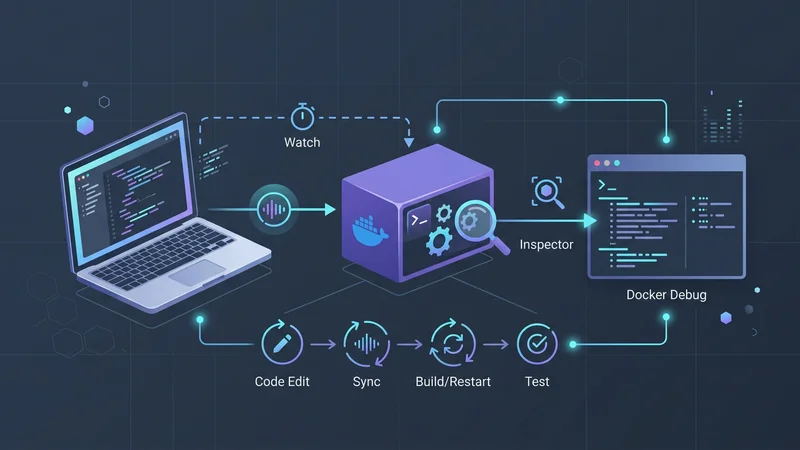

Pentru dezvoltatorii web, „inner loop” este ciclul de scriere a codului, testare și depanare (debugging). Istoric, Docker a adăugat fricțiune acestui proces — așteptarea finalizării build-urilor era un factor comun de scădere a productivității. În 2025, Docker s-a orientat către dezvoltarea „zero-fricțiune”.

Docker Init și Docker Debug

Una dintre cele mai importante adăugiri este docker init. În loc să cauți manual pe StackOverflow fișierul Dockerfile perfect pentru backend-ul tău în Next.js sau Go, poți pur și simplu să rulezi:

docker initAcest utilitar îți scanează proiectul și generează fișierele Dockerfile, .dockerignore și compose.yaml optimizate și adaptate framework-ului tău specific.

Mai mult, Docker Debug (introdus în versiunea 4.50+) rezolvă dilema imaginilor de tip „slim”. Dezvoltatorii folosesc adesea imagini „distroless” sau minimale pentru securitate, dar acestea sunt greu de depanat deoarece le lipsește un shell. Docker Debug oferă un set de instrumente încorporat, agnostic de limbaj, care se atașează oricărui container — chiar și celor fără shell — permițându-ți să inspectezi sistemul de fișiere și starea proceselor fără a mări dimensiunea imaginii de producție.

Dezvoltare în timp real cu Compose Watch

Zilele în care rulai manual docker-compose up --build după fiecare modificare de CSS s-au încheiat. Modul „Watch” din Docker Compose permite sincronizarea în sub-secundă între codul sursă local și container.

# compose.yaml

services:

web:

build: .

ports:

- "3000:3000"

develop:

watch:

- action: sync

path: ./src

target: /app/src

ignore:

- node_modules/

- action: rebuild

path: package.jsonCu această configurație, modificările din directorul tău src sunt sincronizate instantaneu în containerul care rulează, în timp ce modificările aduse fișierului package.json declanșează o reconstrucție automată a imaginii.

Kubernetes pentru dezvoltatori web: Dincolo de entuziasm

Dacă Docker se ocupă de împachetare, Kubernetes (K8s) se ocupă de supraviețuire. Ca dezvoltator web, nu trebuie să fii un administrator de cluster, dar trebuie să înțelegi cum gestionează Kubernetes v1.32 („Penelope”) și v1.33 ciclul de viață al aplicației tale.

Native Sidecar Containers

Un punct sensibil major în Kubernetes a fost ciclul de viață al containerelor de tip sidecar (de exemplu, agenți de logging sau proxy-uri de autentificare). Anterior, sidecar-urile s-ar fi putut închide înainte ca aplicația principală să termine procesarea unei ultime cereri, ducând la pierderea datelor. În v1.33, Native Sidecar Containers au ajuns la General Availability. Acum poți defini un container ca sidecar, asigurându-te că pornește înainte de aplicația ta și se oprește după aceasta, oferind o experiență fluidă pentru service meshes precum Istio sau Linkerd.

In-Place Pod Vertical Scaling

Tradițional, schimbarea limitelor de CPU sau memorie ale unui Pod necesita o repornire completă. Pentru o aplicație React/Node.js cu trafic intens, acest lucru însemna o scurtă perioadă de indisponibilitate sau necesitatea unor rolling updates complexe. Kubernetes modern suportă acum In-Place Pod Vertical Scaling. Poți actualiza cererile/limitele de resurse din mers, iar Kubelet va ajusta resursele containerului fără a opri procesul — perfect pentru a gestiona vârfurile bruște de trafic în timpul lansării unui produs.

Gateway API: Succesorul lui Ingress

Ani de zile, Ingress API a fost standardul pentru rutarea traficului extern către serviciile web. Totuși, acesta era limitat și necesita adesea adnotări specifice furnizorilor. Kubernetes Gateway API este acum standardul. Acesta oferă o modalitate mai expresivă și orientată pe roluri de a gestiona traficul, facilitând definirea de către dezvoltatori a deployment-urilor blue-green sau a canary releases direct în manifestele lor.

Arhitecturarea aplicațiilor web: Multi-Stage Builds și integrare AI

Construirea unor imagini eficiente nu mai este opțională. Într-o eră a stocării în cloud „pay-per-byte” și a mediilor efemere, dimensiunea imaginii tale are un impact direct asupra vitezei de deployment și a costurilor.

Multi-Stage Builds standardizate

Pentru o aplicație modernă TypeScript/Node.js, build-ul multi-stage este standardul de aur. Acesta asigură că imaginea finală de producție conține doar artifactele necesare, excluzând devDependencies și codul sursă.

# Etapa 1: Build

FROM node:22-alpine AS builder

WORKDIR /app

COPY package*.json ./

# Utilizarea npm ci pentru build-uri deterministe în CI/CD

RUN npm ci

COPY . .

RUN npm run build

# Etapa 2: Runtime

FROM node:22-alpine AS runner

# Setarea mediului pe producție

ENV NODE_ENV=production

# Rularea ca utilizator non-root pentru securitate

USER node

WORKDIR /app

# Copierea doar a output-ului compilat și a modulelor necesare

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/package.json ./package.json

EXPOSE 3000

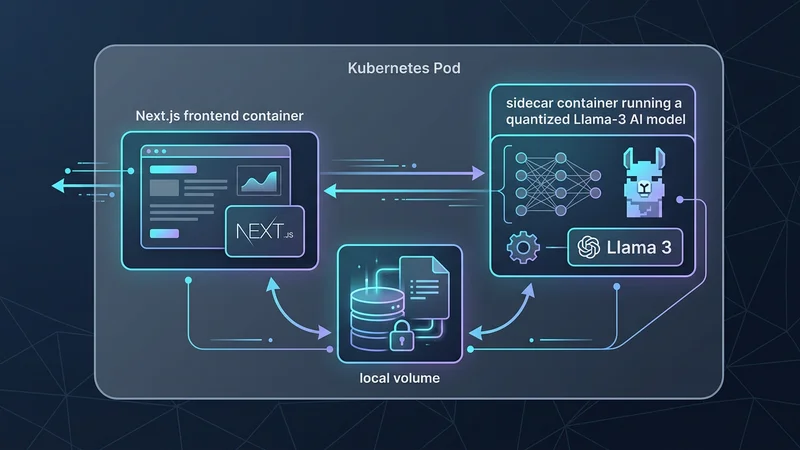

CMD ["node", "dist/main.js"]Containere AI-Native și DRA

Cea mai mare tendință în 2025 este integrarea funcțiilor AI direct în aplicațiile web. Fie că rulezi un LLM local pentru confidențialitatea datelor sau o bază de date vectorială pentru RAG (Retrieval-Augmented Generation), Kubernetes a evoluat pentru a susține aceste sarcini de lucru.

Dynamic Resource Allocation (DRA) permite Kubernetes să gestioneze GPU-urile ca resurse de prim rang. Dezvoltatorii web pot acum solicita fracțiuni de GPU pentru sarcini de inferență în specificațiile Pod-urilor lor, similar modului în care solicită CPU sau RAM.

Securitate și performanță: Evitarea greșelilor comune

Pe măsură ce complexitatea mediilor containerizate crește, crește și suprafața de eroare. Mai jos sunt cele mai frecvente capcane pe care le întâmpină dezvoltatorii web și strategiile pentru a le atenua.

| Capcană | Consecință | Strategie de prevenire |

|---|---|---|

COPY . . prea larg |

Secrete (ca .env) sau log-uri locale scurse în straturile imaginii. |

Folosește un .dockerignore strict și scanează imaginile cu Docker Scout. |

| Lipsa limitelor de resurse | Sindromul „Noisy Neighbor”; un serviciu consumă tot RAM-ul nodului. | Definește întotdeauna resources: limits și requests în manifestele K8s. |

Utilizarea tag-urilor :latest |

Deployment-uri non-deterministe; imposibil de făcut rollback în siguranță. | Folosește versionarea semantică (ex: :v1.2.4) sau SHA digests. |

| Rularea ca Root | Risc crescut de vulnerabilități de tip container escape. | Include întotdeauna USER node sau un UID specific în Dockerfile. |

| Ignorarea sondelor (probes) | Trafic trimis către containere care încă pornesc sau au crăpat. | Implementează livenessProbe și readinessProbe pentru fiecare serviciu. |

Implementarea sondelor în Node.js

O greșeală comună este neglijarea sănătății containerului. Kubernetes trebuie să știe când aplicația ta este gata să primească trafic.

// Un simplu check de readiness în Express.js

app.get('/healthz/ready', (req, res) => {

// Verifică conexiunea la DB, cache, etc.

const isDbConnected = checkDbStatus();

if (isDbConnected) {

res.status(200).send('Ready');

} else {

res.status(503).send('Service Unavailable');

}

});În manifestul tău Kubernetes:

readinessProbe:

httpGet:

path: /healthz/ready

port: 3000

initialDelaySeconds: 5

periodSeconds: 10Peisajul instrumentelor în 2025

Ecosistemul din jurul Docker și Kubernetes s-a maturizat, oferind instrumente care fac gestionarea mult mai ușoară pentru dezvoltatori.

- OrbStack: Pentru utilizatorii de macOS, OrbStack a înlocuit în mare măsură Docker Desktop pentru mulți, datorită consumului semnificativ mai mic de CPU și memorie și timpilor de pornire ultra-rapizi.

- Lens / OpenLens: Cunoscut ca „IDE-ul pentru Kubernetes”, Lens oferă o interfață vizuală pentru explorarea clusterelor, vizualizarea log-urilor și chiar deschiderea de terminale în pod-uri fără a reține comenzi complexe de

kubectl. - KEDA (Kubernetes Event-driven Autoscaling): În timp ce K8s scalează pe baza CPU/RAM, KEDA îți permite să scalezi pod-urile web pe baza evenimentelor la nivel de aplicație, cum ar fi numărul de mesaje dintr-o coadă RabbitMQ sau latența unei metrici Prometheus.

- Trivy: Acesta este standardul industriei pentru securitate. Integrează Trivy în pipeline-ul tău CI/CD pentru a scana Dockerfiles și manifestele YAML de Kubernetes pentru configurări greșite și vulnerabilități înainte ca acestea să ajungă în producție.

Întrebări frecvente

Este cu adevărat necesar ca dezvoltatorii web să învețe Docker?

Da, Docker a devenit standardul industriei pentru asigurarea consecvenței mediului între dezvoltare, staging și producție. Învățarea Docker îți permite să împachetezi dependențele și mediile de runtime, eliminând complet problema „la mine pe mașină funcționează”.

Care este diferența dintre Docker și Kubernetes?

Docker este un instrument utilizat pentru a crea, distribui și rula containere individuale pe o singură gazdă. Kubernetes este o platformă de orchestrare care gestionează clustere de containere, ocupându-se de scalare, echilibrarea sarcinii și auto-vindecare pe mai multe mașini.

Ar trebui să învăț Docker sau Kubernetes mai întâi?

Ar trebui cu siguranță să înveți Docker mai întâi, deoarece acesta oferă blocurile de construcție fundamentale (containerele) pe care Kubernetes le gestionează. Înțelegerea modului în care se construiește și se rulează un singur container este o condiție prealabilă pentru a înțelege cum să orchestrezi sute de astfel de containere într-un cluster.

Pot folosi Docker fără Kubernetes pentru proiecte mici?

Absolut; pentru proiecte mici sau aplicații secundare simple, Docker Compose sau un „Platform as a Service” (PaaS) precum Railway sau Render este adesea suficient. Kubernetes este în general rezervat aplicațiilor care necesită disponibilitate ridicată, scalare complexă sau orchestrare de microservicii.

Cum îmbunătățește Kubernetes scalabilitatea aplicațiilor web?

Kubernetes îmbunătățește scalabilitatea prin caracteristici precum Horizontal Pod Autoscaler (HPA), care adaugă automat mai multe instanțe ale aplicației tale pe baza traficului. De asemenea, gestionează echilibrarea sarcinii și rutarea traficului, asigurându-se că noile instanțe încep să primească cereri imediat, fără configurare manuală.

Concluzie

În 2025 și 2026, rolurile de „Developer” și „Operator” continuă să fuzioneze în disciplina Platform Engineering. Pentru dezvoltatorii web, Docker și Kubernetes nu mai sunt doar ținte de deployment; ele sunt pânza pe care sunt construite aplicațiile moderne, reziliente și alimentate de AI.

Stăpânind „inner loop”-ul cu instrumente precum Docker Compose Watch și docker init și înțelegând „outer loop”-ul cu sidecar-uri Kubernetes și Gateway API, te poziționezi în fruntea industriei. Scopul nu este doar să scrii cod care rulează — ci să scrii cod care scalează, supraviețuiește și reușește într-o lume cloud-native. Începe cu pași mici, containerizează-ți proiectul actual și explorează treptat puterea de orchestrare pe care o oferă Kubernetes. Viitorul web-ului este containerizat.