A Evolução da Conteinerização: Por que os Desenvolvedores Web Não Podem Ignorar o Docker e o Kubernetes em 2025

O cenário do desenvolvimento web mudou. Em anos anteriores, a conteinerização era frequentemente vista como "um problema da equipe de DevOps". No entanto, à medida que avançamos para 2025 e 2026, a fronteira entre escrever código e gerenciar seu ambiente de execução evaporou. Com a ascensão de fluxos de trabalho integrados com IA, arquiteturas de micro-frontends e engenharia de plataforma, o Docker e o Kubernetes tornaram-se tão fundamentais no kit de ferramentas de um desenvolvedor web quanto o Git ou o TypeScript.

As aplicações web modernas não são mais apenas uma coleção de arquivos estáticos ou um único servidor monolítico. Elas são ecossistemas complexos que envolvem LLMs (Large Language Models) locais, bancos de dados vetoriais e funções de edge distribuídas. O Docker fornece a consistência necessária para empacotar esses diversos componentes, enquanto o Kubernetes oferece a orquestração para garantir que eles permaneçam resilientes e escaláveis.

Este guia explora o estado atual da conteinerização, focando nos recursos mais recentes do Docker 4.50+ e Kubernetes v1.33, e como você pode aproveitá-los para construir aplicações web mais rápidas e seguras.

Docker Moderno: Otimizando o "Inner Loop"

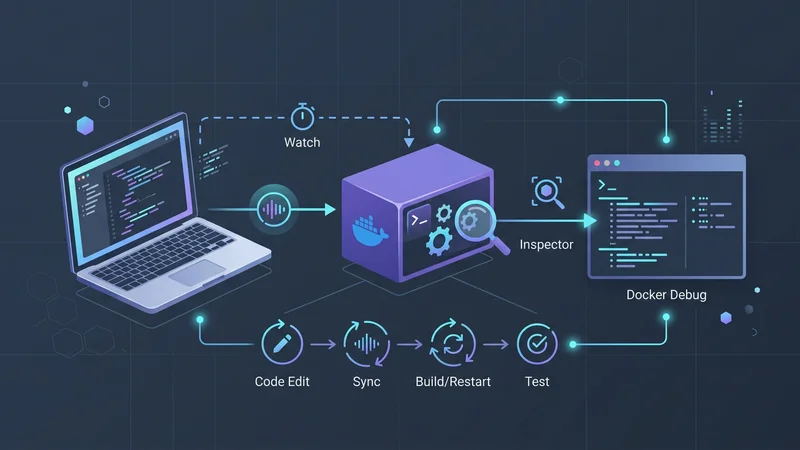

Para desenvolvedores web, o "inner loop" é o ciclo de codificação, teste e depuração. Historicamente, o Docker adicionava fricção a esse processo — esperar o término das builds era um assassino comum de produtividade. Em 2025, o Docker pivotou em direção ao desenvolvimento com "zero fricção".

Docker Init e Docker Debug

Uma das adições mais significativas é o docker init. Em vez de vasculhar manualmente o StackOverflow em busca do Dockerfile perfeito para seu backend em Next.js ou Go, você pode simplesmente executar:

docker initEste utilitário escaneia seu projeto e gera arquivos Dockerfile, .dockerignore e compose.yaml otimizados e adaptados ao seu framework específico.

Além disso, o Docker Debug (introduzido na versão 4.50+) resolve o dilema das "imagens slim". Desenvolvedores frequentemente usam imagens "distroless" ou mínimas por segurança, mas estas são notoriamente difíceis de depurar porque carecem de um shell. O Docker Debug fornece um conjunto de ferramentas integrado e agnóstico a linguagem que se anexa a qualquer container — mesmo aqueles sem shell — permitindo que você inspecione o sistema de arquivos e o estado do processo sem inflar sua imagem de produção.

Desenvolvimento em Tempo Real com Compose Watch

Os dias de docker-compose up --build manual após cada alteração de CSS acabaram. O modo "Watch" do Docker Compose permite a sincronização em menos de um segundo entre seu código-fonte local e o container.

# compose.yaml

services:

web:

build: .

ports:

- "3000:3000"

develop:

watch:

- action: sync

path: ./src

target: /app/src

ignore:

- node_modules/

- action: rebuild

path: package.jsonCom esta configuração, as alterações no seu diretório src são sincronizadas instantaneamente com o container em execução, enquanto alterações no package.json disparam uma reconstrução automática da imagem.

Kubernetes para Desenvolvedores Web: Além do Hype

Se o Docker trata de empacotamento, o Kubernetes (K8s) trata de sobrevivência. Como desenvolvedor web, você não precisa ser um administrador de cluster, mas precisa entender como o Kubernetes v1.32 ("Penelope") e o v1.33 lidam com o ciclo de vida da sua aplicação.

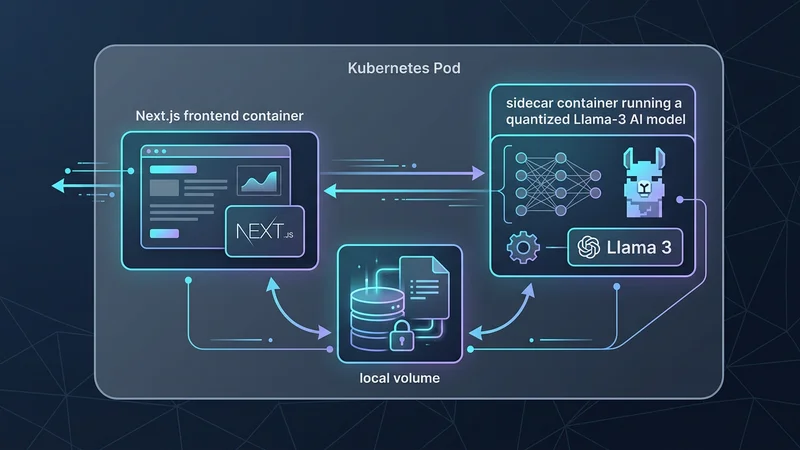

Containers Sidecar Nativos

Um grande ponto de dor no Kubernetes era o ciclo de vida dos containers sidecar (ex: agentes de log ou proxies de autenticação). Anteriormente, os sidecars podiam desligar antes que a aplicação principal terminasse de processar uma requisição final, levando à perda de dados. Na v1.33, os Native Sidecar Containers alcançaram Disponibilidade Geral (GA). Agora você pode definir um container como sidecar, garantindo que ele inicie antes da sua aplicação e desligue depois dela, proporcionando uma experiência perfeita para service meshes como Istio ou Linkerd.

Escalonamento Vertical de Pods In-Place

Tradicionalmente, alterar os limites de CPU ou memória de um Pod exigia um reinício completo. Para uma aplicação React/Node.js de alto tráfego, isso significava um breve período de indisponibilidade ou a necessidade de atualizações complexas (rolling updates). O Kubernetes moderno agora suporta In-Place Pod Vertical Scaling. Você pode atualizar as requisições/limites de recursos em tempo real, e o Kubelet ajustará os recursos do container sem matar o processo — perfeito para lidar com picos repentinos durante o lançamento de um produto.

A Gateway API: O Sucessor do Ingress

Por anos, a Ingress API foi o padrão para rotear tráfego externo para serviços web. No entanto, ela era limitada e frequentemente exigia anotações específicas de fornecedores. A Kubernetes Gateway API é agora o padrão. Ela fornece uma maneira mais expressiva e orientada a funções para gerenciar o tráfego, facilitando para os desenvolvedores a definição de blue-green deployments ou canary releases diretamente em seus manifestos.

Arquitetando Apps Web: Multi-Stage Builds e Integração com IA

Construir imagens eficientes não é mais opcional. Em uma era de armazenamento em nuvem "pague por byte" e ambientes efêmeros, o tamanho da sua imagem impacta diretamente a velocidade e o custo do deploy.

Multi-Stage Builds Padronizados

Para uma aplicação moderna em TypeScript/Node.js, um build de múltiplos estágios (multi-stage build) é o padrão ouro. Ele garante que sua imagem final de produção contenha apenas os artefatos necessários, excluindo devDependencies e código-fonte.

# Estágio 1: Build

FROM node:22-alpine AS builder

WORKDIR /app

COPY package*.json ./

# Use npm ci para builds determinísticos em CI/CD

RUN npm ci

COPY . .

RUN npm run build

# Estágio 2: Runtime

FROM node:22-alpine AS runner

# Define o ambiente para produção

ENV NODE_ENV=production

# Executa como um usuário não-root por segurança

USER node

WORKDIR /app

# Copia apenas a saída compilada e os módulos necessários

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/package.json ./package.json

EXPOSE 3000

CMD ["node", "dist/main.js"]Containers Nativos de IA e DRA

A maior tendência em 2025 é a integração de recursos de IA diretamente em apps web. Esteja você executando um LLM local para privacidade de dados ou um banco de dados vetorial para RAG (Geração Aumentada de Recuperação), o Kubernetes evoluiu para suportar essas cargas de trabalho.

O Dynamic Resource Allocation (DRA) permite que o Kubernetes gerencie GPUs como cidadãos de primeira classe. Desenvolvedores web agora podem solicitar frações de GPU para tarefas de inferência dentro de suas especificações de Pod, de forma semelhante a como solicitam CPU ou RAM.

Segurança e Performance: Evitando Armadilhas Comuns

À medida que a complexidade dos ambientes conteinerizados cresce, também cresce a superfície para erros. Abaixo estão as armadilhas mais comuns que os desenvolvedores web enfrentam e as estratégias para mitigá-las.

| Armadilha | Consequência | Estratégia de Prevenção |

|---|---|---|

COPY . . genérico |

Segredos (como .env) ou logs locais vazados nas camadas da imagem. |

Use um .dockerignore rigoroso e escaneie imagens com o Docker Scout. |

| Falta de limites de recursos | Síndrome do "Noisy Neighbor"; um serviço consome toda a RAM do Node. | Sempre defina resources: limits e requests nos manifestos do K8s. |

Uso de tags :latest |

Deploys não determinísticos; impossível reverter de forma confiável. | Use versionamento semântico (ex: :v1.2.4) ou digests SHA. |

| Executar como Root | Aumento do risco de vulnerabilidades de escape de container. | Sempre inclua USER node ou um UID específico no seu Dockerfile. |

| Ignorar Probes | Tráfego enviado para containers que ainda estão iniciando ou travaram. | Implemente livenessProbe e readinessProbe para cada serviço. |

Implementando Probes em Node.js

Um erro comum é negligenciar a saúde do container. O Kubernetes precisa saber quando seu app está pronto para receber tráfego.

// Um check de prontidão simples em Express.js

app.get('/healthz/ready', (req, res) => {

// Verifica conexão com DB, cache, etc.

const isDbConnected = checkDbStatus();

if (isDbConnected) {

res.status(200).send('Ready');

} else {

res.status(503).send('Service Unavailable');

}

});No seu manifesto Kubernetes:

readinessProbe:

httpGet:

path: /healthz/ready

port: 3000

initialDelaySeconds: 5

periodSeconds: 10O Cenário de Ferramentas em 2025

O ecossistema em torno do Docker e Kubernetes amadureceu, oferecendo ferramentas que tornam o gerenciamento significativamente mais fácil para os desenvolvedores.

- OrbStack: Para usuários de macOS, o OrbStack substituiu amplamente o Docker Desktop para muitos devido ao seu overhead de CPU e memória significativamente menor e tempos de inicialização ultrarrápidos.

- Lens / OpenLens: Conhecido como a "IDE para Kubernetes", o Lens fornece uma interface visual para explorar clusters, visualizar logs e até abrir shells de terminal em pods sem precisar lembrar comandos complexos de

kubectl. - KEDA (Kubernetes Event-driven Autoscaling): Enquanto o K8s escala com base em CPU/RAM, o KEDA permite que você escale seus pods web com base em eventos de nível de aplicação, como o número de mensagens em uma fila RabbitMQ ou a latência de uma métrica do Prometheus.

- Trivy: Este é o padrão da indústria para segurança. Integre o Trivy ao seu pipeline de CI/CD para escanear seus Dockerfiles e YAMLs do Kubernetes em busca de más configurações e vulnerabilidades antes que cheguem à produção.

Perguntas Frequentes

É realmente necessário para desenvolvedores web aprenderem Docker?

Sim, o Docker tornou-se o padrão da indústria para garantir a consistência do ambiente entre desenvolvimento, staging e produção. Aprender Docker permite empacotar dependências e ambientes de execução, eliminando inteiramente o problema do "funciona na minha máquina".

Qual é a diferença entre Docker e Kubernetes?

Docker é uma ferramenta usada para criar, distribuir e executar containers individuais em um único host. Kubernetes é uma plataforma de orquestração que gerencia clusters de containers, lidando com escalonamento, balanceamento de carga e autorrecuperação em várias máquinas.

Devo aprender Docker ou Kubernetes primeiro?

Você definitivamente deve aprender Docker primeiro, pois ele fornece os blocos de construção fundamentais (containers) que o Kubernetes gerencia. Entender como construir e rodar um único container é um pré-requisito para entender como orquestrar centenas deles em um cluster.

Posso usar Docker sem Kubernetes para projetos pequenos?

Com certeza; para projetos pequenos ou apps simples, o Docker Compose ou uma "Plataforma como Serviço" (PaaS) como Railway ou Render é frequentemente suficiente. O Kubernetes é geralmente reservado para aplicações que exigem alta disponibilidade, escalonamento complexo ou orquestração de microsserviços.

Como o Kubernetes melhora a escalabilidade de aplicações web?

O Kubernetes melhora a escalabilidade através de recursos como o Horizontal Pod Autoscaler (HPA), que adiciona automaticamente mais instâncias do seu app com base no tráfego. Ele também gerencia o balanceamento de carga e o roteamento de tráfego, garantindo que novas instâncias comecem a receber requisições imediatamente sem configuração manual.

Conclusão

Em 2025 e 2026, os papéis de "Desenvolvedor" e "Operador" continuam a se fundir na disciplina de Engenharia de Plataforma. Para desenvolvedores web, o Docker e o Kubernetes não são mais apenas alvos de deploy; eles são a tela sobre a qual aplicações modernas, resilientes e movidas a IA são construídas.

Ao dominar o "inner loop" com ferramentas como Docker Compose Watch e docker init, e entender o "outer loop" com sidecars do Kubernetes e a Gateway API, você se posiciona na vanguarda da indústria. O objetivo não é apenas escrever código que roda — é escrever código que escala, sobrevive e prospera em um mundo cloud-native. Comece pequeno, conteinerize seu projeto atual e explore gradualmente o poder de orquestração que o Kubernetes oferece. O futuro da web é conteinerizado.