L'évolution de la conteneurisation : Pourquoi les développeurs web ne peuvent plus ignorer Docker et Kubernetes en 2025

Le paysage du développement web a radicalement changé. Auparavant, la conteneurisation était souvent perçue comme « le problème de l'équipe DevOps ». Cependant, à l'aube de 2025 et 2026, la frontière entre l'écriture du code et la gestion de son environnement d'exécution s'est évaporée. Avec l'essor des flux de travail intégrés à l'IA, des architectures micro-frontend et du Platform Engineering, Docker et Kubernetes sont devenus aussi fondamentaux pour un développeur web que Git ou TypeScript.

Les applications web modernes ne sont plus de simples collections de fichiers statiques ou un serveur monolithique unique. Ce sont des écosystèmes complexes impliquant des LLMs (Large Language Models) locaux, des bases de données vectorielles et des fonctions edge distribuées. Docker offre la cohérence nécessaire pour packager ces divers composants, tandis que Kubernetes assure l'orchestration pour garantir leur résilience et leur scalabilité.

Ce guide explore l'état actuel de la conteneurisation, en se concentrant sur les dernières fonctionnalités de Docker 4.50+ et Kubernetes v1.33, et sur la manière dont vous pouvez les exploiter pour créer des applications web plus rapides et plus sécurisées.

Docker moderne : Optimiser la « boucle interne »

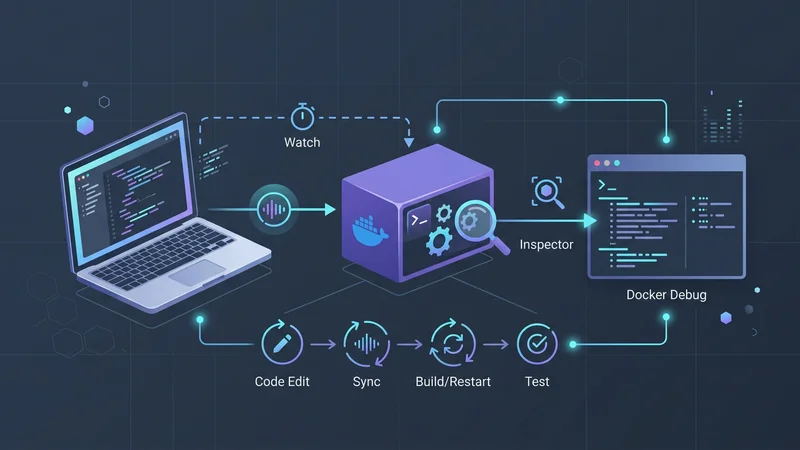

Pour les développeurs web, la « boucle interne » (inner loop) est le cycle de codage, de test et de débogage. Historiquement, Docker ajoutait une certaine friction à ce processus — attendre la fin des builds était un frein majeur à la productivité. En 2025, Docker a pivoté vers un développement « sans friction ».

Docker Init et Docker Debug

L'un des ajouts les plus significatifs est docker init. Au lieu de parcourir manuellement StackOverflow pour trouver le Dockerfile parfait pour votre backend Next.js ou Go, il vous suffit de lancer :

docker initCet utilitaire analyse votre projet et génère des fichiers Dockerfile, .dockerignore et compose.yaml optimisés et adaptés à votre framework spécifique.

De plus, Docker Debug (introduit dans la version 4.50+) résout le dilemme de l'« image slim ». Les développeurs utilisent souvent des images « distroless » ou minimales pour la sécurité, mais celles-ci sont notoirement difficiles à déboguer car elles n'ont pas de shell. Docker Debug fournit un ensemble d'outils intégrés et agnostiques au langage qui s'attachent à n'importe quel conteneur — même ceux sans shell — vous permettant d'inspecter le système de fichiers et l'état des processus sans alourdir votre image de production.

Développement en temps réel avec Compose Watch

L'époque du docker-compose up --build manuel après chaque modification CSS est révolue. Le mode « Watch » de Docker Compose permet une synchronisation en moins d'une seconde entre votre code source local et le conteneur.

# compose.yaml

services:

web:

build: .

ports:

- "3000:3000"

develop:

watch:

- action: sync

path: ./src

target: /app/src

ignore:

- node_modules/

- action: rebuild

path: package.jsonAvec cette configuration, les modifications apportées à votre répertoire src sont instantanément synchronisées avec le conteneur en cours d'exécution, tandis que les modifications de package.json déclenchent une reconstruction automatique de l'image.

Kubernetes pour les développeurs web : Au-delà de l'effet de mode

Si Docker s'occupe du packaging, Kubernetes (K8s) s'occupe de la survie. En tant que développeur web, vous n'avez pas besoin d'être un administrateur de cluster, mais vous devez comprendre comment Kubernetes v1.32 (« Penelope ») et v1.33 gèrent le cycle de vie de votre application.

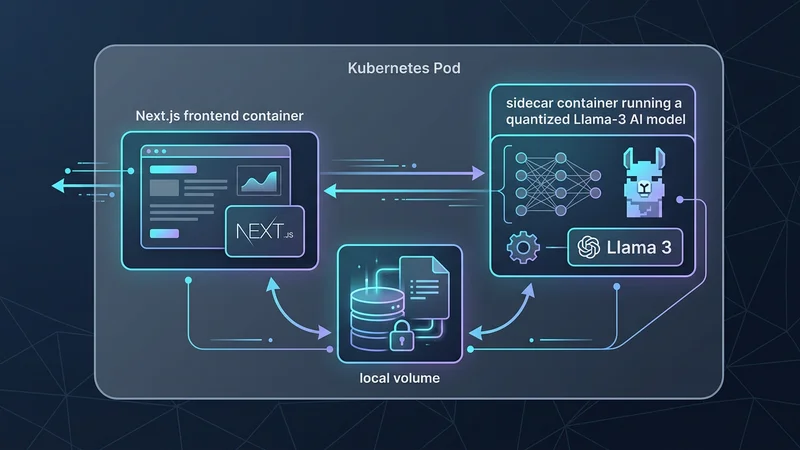

Conteneurs Sidecar natifs

Un point de friction majeur dans Kubernetes était le cycle de vie des conteneurs sidecar (par exemple, les agents de logging ou les proxies d'authentification). Auparavant, les sidecars pouvaient s'arrêter avant que l'application principale n'ait fini de traiter une dernière requête, entraînant des pertes de données. Dans la v1.33, les Conteneurs Sidecar Natifs sont passés en disponibilité générale (GA). Vous pouvez désormais définir un conteneur comme sidecar, garantissant qu'il démarre avant votre application et s'arrête après elle, offrant une expérience fluide pour les services meshes comme Istio ou Linkerd.

Mise à l'échelle verticale des Pods sur place (In-Place)

Traditionnellement, modifier les limites de CPU ou de mémoire d'un Pod nécessitait un redémarrage complet. Pour une application React/Node.js à fort trafic, cela signifiait une brève période d'indisponibilité ou la nécessité de mises à jour progressives complexes. Le Kubernetes moderne prend désormais en charge l'In-Place Pod Vertical Scaling. Vous pouvez mettre à jour les requêtes/limites de ressources à la volée, et le Kubelet ajustera les ressources du conteneur sans tuer le processus — idéal pour gérer les pics soudains lors d'un lancement de produit.

La Gateway API : Le successeur de l'Ingress

Pendant des années, l'API Ingress était la norme pour router le trafic externe vers les services web. Cependant, elle était limitée et nécessitait souvent des annotations spécifiques aux fournisseurs. La Kubernetes Gateway API est désormais le standard. Elle offre une manière plus expressive et orientée rôles de gérer le trafic, facilitant pour les développeurs la définition de déploiements blue-green ou de canary releases directement dans leurs manifestes.

Architecturer des applications web : Builds multi-étapes et intégration de l'IA

Construire des images efficaces n'est plus optionnel. À l'ère du stockage cloud « au mégaoctet » et des environnements éphémères, la taille de votre image impacte directement la vitesse de déploiement et le coût.

Builds multi-étapes standardisés

Pour une application TypeScript/Node.js moderne, le build multi-étapes (multi-stage build) est la règle d'or. Il garantit que votre image de production finale ne contient que les artefacts nécessaires, excluant les devDependencies et le code source.

# Étape 1 : Build

FROM node:22-alpine AS builder

WORKDIR /app

COPY package*.json ./

# Utilisation de npm ci pour des builds déterministes en CI/CD

RUN npm ci

COPY . .

RUN npm run build

# Étape 2 : Runtime

FROM node:22-alpine AS runner

# Définir l'environnement en production

ENV NODE_ENV=production

# Exécuter en tant qu'utilisateur non-root pour la sécurité

USER node

WORKDIR /app

# Copier uniquement la sortie compilée et les modules nécessaires

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/package.json ./package.json

EXPOSE 3000

CMD ["node", "dist/main.js"]Conteneurs AI-Native et DRA

La plus grande tendance de 2025 est l'intégration de fonctionnalités d'IA directement dans les applications web. Que vous exécutiez un LLM local pour la confidentialité des données ou une base de données vectorielle pour le RAG (Retrieval-Augmented Generation), Kubernetes a évolué pour supporter ces charges de travail.

Le Dynamic Resource Allocation (DRA) permet à Kubernetes de gérer les GPUs comme des citoyens de première classe. Les développeurs web peuvent désormais demander des fractions de GPU pour des tâches d'inférence dans leurs specs de Pod, de la même manière qu'ils demandent du CPU ou de la RAM.

Sécurité et performance : Éviter les pièges courants

À mesure que la complexité des environnements conteneurisés augmente, la surface d'erreur s'accroît également. Voici les pièges les plus courants auxquels sont confrontés les développeurs web et les stratégies pour les atténuer.

| Piège | Conséquence | Stratégie de prévention |

|---|---|---|

COPY . . trop large |

Secrets (comme .env) ou logs locaux fuitent dans les couches de l'image. |

Utilisez un .dockerignore strict et scannez les images avec Docker Scout. |

| Absence de limites de ressources | Syndrome du « voisin bruyant » ; un service consomme toute la RAM du Node. | Définissez toujours resources: limits et requests dans les manifestes K8s. |

Utilisation des tags :latest |

Déploiements non déterministes ; impossible de revenir en arrière de manière fiable. | Utilisez le versionnage sémantique (ex: :v1.2.4) ou les digests SHA. |

| Exécution en tant que Root | Risque accru de vulnérabilités d'évasion de conteneur. | Incluez toujours USER node ou un UID spécifique dans votre Dockerfile. |

| Ignorer les sondes (Probes) | Trafic envoyé à des conteneurs encore en cours de démarrage ou plantés. | Implémentez livenessProbe et readinessProbe pour chaque service. |

Implémentation des sondes dans Node.js

Une erreur courante consiste à négliger la santé du conteneur. Kubernetes doit savoir quand votre application est prête à recevoir du trafic.

// Un simple check de disponibilité Express.js

app.get('/healthz/ready', (req, res) => {

// Vérifier la connexion DB, le cache, etc.

const isDbConnected = checkDbStatus();

if (isDbConnected) {

res.status(200).send('Ready');

} else {

res.status(503).send('Service Unavailable');

}

});Dans votre manifeste Kubernetes :

readinessProbe:

httpGet:

path: /healthz/ready

port: 3000

initialDelaySeconds: 5

periodSeconds: 10Le paysage des outils en 2025

L'écosystème autour de Docker et Kubernetes a mûri, offrant des outils qui facilitent considérablement la gestion pour les développeurs.

- OrbStack : Pour les utilisateurs macOS, OrbStack a largement remplacé Docker Desktop pour beaucoup en raison de sa consommation CPU/mémoire nettement inférieure et de ses temps de démarrage ultra-rapides.

- Lens / OpenLens : Connu comme l'« IDE pour Kubernetes », Lens fournit une interface visuelle pour explorer les clusters, consulter les logs et même ouvrir des terminaux dans les pods sans avoir à retenir des commandes

kubectlcomplexes. - KEDA (Kubernetes Event-driven Autoscaling) : Alors que K8s scale en fonction du CPU/RAM, KEDA vous permet de scaler vos pods web en fonction d'événements applicatifs, comme le nombre de messages dans une file RabbitMQ ou la latence d'une métrique Prometheus.

- Trivy : C'est le standard de l'industrie pour la sécurité. Intégrez Trivy dans votre pipeline CI/CD pour scanner vos Dockerfiles et YAMLs Kubernetes à la recherche de mauvaises configurations et de vulnérabilités avant qu'ils n'atteignent la production.

Questions Fréquemment Posées

Est-il vraiment nécessaire pour les développeurs web d'apprendre Docker ?

Oui, Docker est devenu le standard de l'industrie pour assurer la cohérence de l'environnement entre le développement, le staging et la production. Apprendre Docker vous permet de packager les dépendances et les environnements d'exécution, éliminant totalement le problème du « ça marche sur ma machine ».

Quelle est la différence entre Docker et Kubernetes ?

Docker est un outil utilisé pour créer, distribuer et exécuter des conteneurs individuels sur un seul hôte. Kubernetes est une plateforme d'orchestration qui gère des clusters de conteneurs, s'occupant de la mise à l'échelle, de l'équilibrage de charge et de l'auto-guérison sur plusieurs machines.

Dois-je apprendre Docker ou Kubernetes en premier ?

Vous devriez absolument apprendre Docker en premier, car il fournit les briques de base (les conteneurs) que Kubernetes gère. Comprendre comment construire et exécuter un seul conteneur est un prérequis pour comprendre comment en orchestrer des centaines dans un cluster.

Puis-je utiliser Docker sans Kubernetes pour de petits projets ?

Absolument ; pour de petits projets ou des applications personnelles simples, Docker Compose ou une plateforme PaaS (Platform as a Service) comme Railway ou Render est souvent suffisante. Kubernetes est généralement réservé aux applications nécessitant une haute disponibilité, une mise à l'échelle complexe ou une orchestration de microservices.

Comment Kubernetes améliore-t-il la scalabilité des applications web ?

Kubernetes améliore la scalabilité grâce à des fonctionnalités telles que le Horizontal Pod Autoscaler (HPA), qui ajoute automatiquement plus d'instances de votre application en fonction du trafic. Il gère également l'équilibrage de charge et le routage du trafic, garantissant que les nouvelles instances reçoivent immédiatement des requêtes sans configuration manuelle.

Conclusion

En 2025 et 2026, les rôles de « Développeur » et d'« Opérateur » continuent de fusionner dans la discipline du Platform Engineering. Pour les développeurs web, Docker et Kubernetes ne sont plus seulement des cibles de déploiement ; ils sont la toile sur laquelle les applications modernes, résilientes et propulsées par l'IA sont construites.

En maîtrisant la « boucle interne » avec des outils comme Docker Compose Watch et docker init, et en comprenant la « boucle externe » avec les sidecars Kubernetes et la Gateway API, vous vous positionnez à l'avant-garde de l'industrie. L'objectif n'est pas seulement d'écrire du code qui fonctionne — c'est d'écrire du code qui scale, qui survit et qui réussit dans un monde cloud-native. Commencez petit, conteneurisez votre projet actuel et explorez progressivement la puissance d'orchestration qu'offre Kubernetes. L'avenir du web est conteneurisé.