La evolución de la contenedorización: Por qué los desarrolladores web no pueden ignorar Docker y Kubernetes en 2025

El panorama del desarrollo web ha cambiado. En años anteriores, la contenedorización se veía a menudo como "un problema del equipo de DevOps". Sin embargo, a medida que avanzamos hacia 2025 y 2026, la frontera entre escribir código y gestionar su entorno de ejecución se ha evaporado. Con el auge de los flujos de trabajo integrados con IA, las arquitecturas de micro-frontends y la ingeniería de plataformas (Platform Engineering), Docker y Kubernetes se han vuelto tan fundamentales en el arsenal de un desarrollador web como Git o TypeScript.

Las aplicaciones web modernas ya no son solo una colección de archivos estáticos o un único servidor monolítico. Son ecosistemas complejos que involucran LLMs (Large Language Models) locales, bases de datos vectoriales y funciones edge distribuidas. Docker proporciona la consistencia necesaria para empaquetar estos diversos componentes, mientras que Kubernetes ofrece la orquestación para asegurar que sigan siendo resilientes y escalables.

Esta guía explora el estado actual de la contenedorización, centrándose en las últimas características de Docker 4.50+ y Kubernetes v1.33, y cómo puedes aprovecharlas para construir aplicaciones web más rápidas y seguras.

Docker moderno: Optimizando el "Inner Loop"

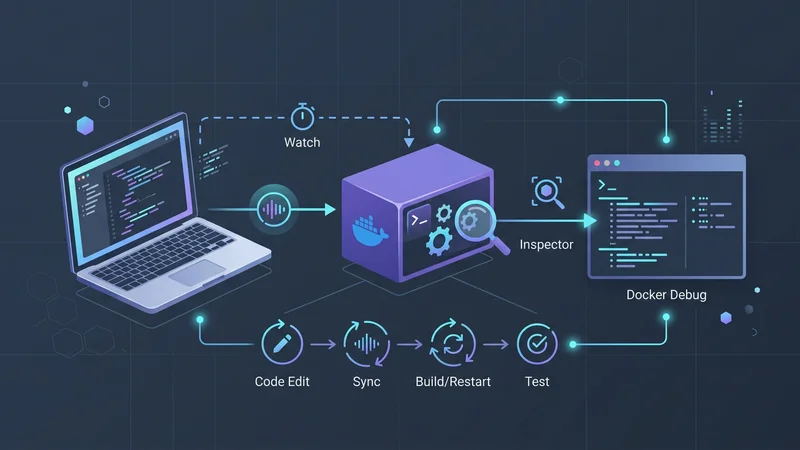

Para los desarrolladores web, el "inner loop" es el ciclo de programar, probar y depurar. Históricamente, Docker añadía fricción a este proceso; esperar a que terminaran las builds era un asesino común de la productividad. En 2025, Docker ha pivotado hacia un desarrollo con "cero fricción".

Docker Init y Docker Debug

Una de las adiciones más significativas es docker init. En lugar de buscar manualmente en StackOverflow el Dockerfile perfecto para tu backend en Next.js o Go, simplemente puedes ejecutar:

docker initEsta utilidad escanea tu proyecto y genera archivos Dockerfile, .dockerignore y compose.yaml optimizados y adaptados a tu framework específico.

Además, Docker Debug (introducido en la versión 4.50+) resuelve el dilema de las "imágenes slim". Los desarrolladores suelen usar imágenes "distroless" o mínimas por seguridad, pero estas son notoriamente difíciles de depurar porque carecen de una shell. Docker Debug proporciona un conjunto de herramientas integrado e independiente del lenguaje que se acopla a cualquier contenedor —incluso a aquellos sin shell— permitiéndote inspeccionar el sistema de archivos y el estado de los procesos sin inflar tu imagen de producción.

Desarrollo en tiempo real con Compose Watch

Los días de ejecutar manualmente docker-compose up --build después de cada cambio en el CSS han terminado. El modo "Watch" de Docker Compose permite una sincronización en menos de un segundo entre tu código fuente local y el contenedor.

# compose.yaml

services:

web:

build: .

ports:

- "3000:3000"

develop:

watch:

- action: sync

path: ./src

target: /app/src

ignore:

- node_modules/

- action: rebuild

path: package.jsonCon esta configuración, los cambios en tu directorio src se sincronizan instantáneamente con el contenedor en ejecución, mientras que los cambios en package.json activan una reconstrucción automática de la imagen.

Kubernetes para desarrolladores web: Más allá del hype

Si Docker se trata de empaquetar, Kubernetes (K8s) se trata de sobrevivir. Como desarrollador web, no necesitas ser un administrador de clústeres, pero sí necesitas entender cómo Kubernetes v1.32 ("Penelope") y v1.33 gestionan el ciclo de vida de tu aplicación.

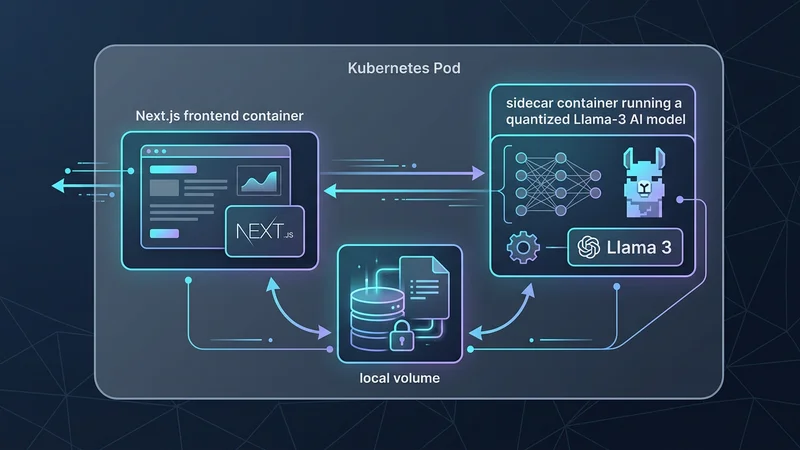

Sidecar Containers nativos

Un punto de dolor importante en Kubernetes era el ciclo de vida de los contenedores sidecar (por ejemplo, agentes de logging o proxies de autenticación). Anteriormente, los sidecars podían cerrarse antes de que la aplicación principal terminara de procesar una solicitud final, lo que provocaba la pérdida de datos. En la v1.33, los Native Sidecar Containers han alcanzado la disponibilidad general (General Availability). Ahora puedes definir un contenedor como sidecar, asegurando que se inicie antes que tu aplicación y se cierre después que ella, proporcionando una experiencia fluida para service meshes como Istio o Linkerd.

Escalado vertical de Pods in-place

Tradicionalmente, cambiar los límites de CPU o memoria de un Pod requería un reinicio completo. Para una aplicación React/Node.js de alto tráfico, esto significaba un breve periodo de indisponibilidad o la necesidad de complejas actualizaciones progresivas (rolling updates). El Kubernetes moderno ahora soporta el In-Place Pod Vertical Scaling. Puedes actualizar las solicitudes/límites de recursos sobre la marcha, y el Kubelet ajustará los recursos del contenedor sin matar el proceso, lo cual es perfecto para manejar picos repentinos durante el lanzamiento de un producto.

El Gateway API: El sucesor de Ingress

Durante años, el Ingress API fue el estándar para enrutar el tráfico externo hacia los servicios web. Sin embargo, era limitado y a menudo requería anotaciones específicas de cada proveedor. El Kubernetes Gateway API es ahora el estándar. Proporciona una forma más expresiva y orientada a roles para gestionar el tráfico, facilitando a los desarrolladores la definición de blue-green deployments o canary releases directamente en sus manifiestos.

Arquitectura de aplicaciones web: Multi-Stage Builds e integración de IA

Construir imágenes eficientes ya no es opcional. En una era de almacenamiento en la nube de "pago por byte" y entornos efímeros, el tamaño de tu imagen impacta directamente en la velocidad de despliegue y en el coste.

Multi-Stage Builds estandarizados

Para una aplicación TypeScript/Node.js moderna, un build de múltiples etapas es el estándar de oro. Asegura que tu imagen final de producción contenga solo los artefactos necesarios, excluyendo devDependencies y el código fuente.

# Etapa 1: Build

FROM node:22-alpine AS builder

WORKDIR /app

COPY package*.json ./

# Usar npm ci para builds deterministas en CI/CD

RUN npm ci

COPY . .

RUN npm run build

# Etapa 2: Runtime

FROM node:22-alpine AS runner

# Configurar el entorno a producción

ENV NODE_ENV=production

# Ejecutar como usuario no-root por seguridad

USER node

WORKDIR /app

# Copiar solo el output compilado y los módulos necesarios

COPY --from=builder /app/dist ./dist

COPY --from=builder /app/node_modules ./node_modules

COPY --from=builder /app/package.json ./package.json

EXPOSE 3000

CMD ["node", "dist/main.js"]Contenedores nativos de IA y DRA

La tendencia más grande en 2025 es la integración de funciones de IA directamente en las aplicaciones web. Ya sea que estés ejecutando un LLM local para la privacidad de los datos o una base de datos vectorial para RAG (Retrieval-Augmented Generation), Kubernetes ha evolucionado para soportar estas cargas de trabajo.

Dynamic Resource Allocation (DRA) permite a Kubernetes gestionar las GPUs como ciudadanos de primera clase. Los desarrolladores web ahora pueden solicitar fracciones de GPU para tareas de inferencia dentro de sus especificaciones de Pod, de forma similar a como solicitan CPU o RAM.

Seguridad y rendimiento: Evitando errores comunes

A medida que crece la complejidad de los entornos contenedorizados, también lo hace la superficie de errores. A continuación se presentan los fallos más comunes que enfrentan los desarrolladores web y las estrategias para mitigarlos.

| Error común | Consecuencia | Estrategia de prevención |

|---|---|---|

COPY . . genérico |

Secretos (como .env) o logs locales filtrados en las capas de la imagen. |

Usa un .dockerignore estricto y escanea imágenes con Docker Scout. |

| Falta de límites de recursos | Síndrome del "Noisy Neighbor"; un servicio consume toda la RAM del nodo. | Define siempre resources: limits y requests en los manifiestos de K8s. |

Uso de etiquetas :latest |

Despliegues no deterministas; imposible revertir de forma fiable. | Usa versionado semántico (ej. :v1.2.4) o digests SHA. |

| Ejecutar como Root | Mayor riesgo de vulnerabilidades de escape del contenedor. | Incluye siempre USER node o un UID específico en tu Dockerfile. |

| Ignorar los Probes | Tráfico enviado a contenedores que aún están arrancando o han fallado. | Implementa livenessProbe y readinessProbe para cada servicio. |

Implementación de Probes en Node.js

Un error común es descuidar la salud del contenedor. Kubernetes necesita saber cuándo tu aplicación está lista para recibir tráfico.

// Un simple chequeo de readiness en Express.js

app.get('/healthz/ready', (req, res) => {

// Verificar conexión a DB, caché, etc.

const isDbConnected = checkDbStatus();

if (isDbConnected) {

res.status(200).send('Ready');

} else {

res.status(503).send('Service Unavailable');

}

});En tu manifiesto de Kubernetes:

readinessProbe:

httpGet:

path: /healthz/ready

port: 3000

initialDelaySeconds: 5

periodSeconds: 10El panorama de herramientas en 2025

El ecosistema alrededor de Docker y Kubernetes ha madurado, ofreciendo herramientas que facilitan significativamente la gestión para los desarrolladores.

- OrbStack: Para los usuarios de macOS, OrbStack ha reemplazado en gran medida a Docker Desktop para muchos debido a su carga de CPU y memoria significativamente menor y tiempos de inicio ultrarrápidos.

- Lens / OpenLens: Conocido como el "IDE para Kubernetes", Lens proporciona una interfaz visual para explorar clústeres, ver logs e incluso abrir terminales en los pods sin tener que recordar complejos comandos de

kubectl. - KEDA (Kubernetes Event-driven Autoscaling): Mientras que K8s escala basándose en CPU/RAM, KEDA te permite escalar tus pods web basándose en eventos a nivel de aplicación, como el número de mensajes en una cola de RabbitMQ o la latencia de una métrica de Prometheus.

- Trivy: Este es el estándar de la industria para la seguridad. Integra Trivy en tu pipeline de CI/CD para escanear tus Dockerfiles y YAMLs de Kubernetes en busca de malas configuraciones y vulnerabilidades antes de que lleguen a producción.

Preguntas frecuentes

¿Es realmente necesario que los desarrolladores web aprendan Docker?

Sí, Docker se ha convertido en el estándar de la industria para asegurar la consistencia del entorno en desarrollo, staging y producción. Aprender Docker te permite empaquetar dependencias y entornos de ejecución, eliminando por completo el problema de "funciona en mi máquina".

¿Cuál es la diferencia entre Docker y Kubernetes?

Docker es una herramienta utilizada para crear, distribuir y ejecutar contenedores individuales en un solo host. Kubernetes es una plataforma de orquestación que gestiona clústeres de contenedores, encargándose del escalado, el balanceo de carga y la auto-recuperación en múltiples máquinas.

¿Debería aprender Docker o Kubernetes primero?

Definitivamente deberías aprender Docker primero, ya que proporciona las piezas fundamentales (contenedores) que Kubernetes gestiona. Entender cómo construir y ejecutar un solo contenedor es un requisito previo para entender cómo orquestar cientos de ellos en un clúster.

¿Puedo usar Docker sin Kubernetes para proyectos pequeños?

Absolutamente; para proyectos pequeños o aplicaciones secundarias simples, Docker Compose o un "Platform as a Service" (PaaS) como Railway o Render suele ser suficiente. Kubernetes se reserva generalmente para aplicaciones que requieren alta disponibilidad, escalado complejo u orquestación de microservicios.

¿Cómo mejora Kubernetes la escalabilidad de las aplicaciones web?

Kubernetes mejora la escalabilidad a través de características como el Horizontal Pod Autoscaler (HPA), que añade automáticamente más instancias de tu aplicación basándose en el tráfico. También gestiona el balanceo de carga y el enrutamiento del tráfico, asegurando que las nuevas instancias comiencen a recibir solicitudes de inmediato sin configuración manual.

Conclusión

En 2025 y 2026, los roles de "Desarrollador" y "Operador" continúan fusionándose en la disciplina de Platform Engineering. Para los desarrolladores web, Docker y Kubernetes ya no son solo objetivos de despliegue; son el lienzo sobre el cual se construyen aplicaciones modernas, resilientes y potenciadas por IA.

Al dominar el "inner loop" con herramientas como Docker Compose Watch y docker init, y entender el "outer loop" con los sidecars de Kubernetes y el Gateway API, te posicionas a la vanguardia de la industria. El objetivo no es solo escribir código que funcione, sino escribir código que escale, sobreviva y tenga éxito en un mundo cloud-native. Empieza poco a poco, contenedoriza tu proyecto actual y explora gradualmente el poder de orquestación que proporciona Kubernetes. El futuro de la web está contenedorizado.