Die Veröffentlichung von Next.js 15 und 16 markiert einen entscheidenden Wendepunkt in der Herangehensweise an Web-Performance. Wir haben uns von der Ära des „magischen“, impliziten Cachings verabschiedet und eine Ära der expliziten, granularen Kontrolle betreten. Mit der Einführung des stabilen React Compilers, Partial Prerendering (PPR) und der revolutionären use cache-Direktive hat sich der App Router zu einer Hochleistungs-Engine entwickelt, die in der Lage ist, Ladezeiten im Subsekundenbereich selbst für komplexe, datenintensive Anwendungen zu liefern.

Die Optimierung einer Next.js-Anwendung im Jahr 2025 bedeutet nicht mehr nur das Minimieren von JavaScript; es geht darum, den Datenfluss zwischen Server und Client mit chirurgischer Präzision zu orchestrieren. Dieser Leitfaden untersucht die fortgeschrittenen Techniken, die erforderlich sind, um die Performance im modernen Next.js-Ökosystem zu meistern.

Die Caching-Revolution: Von implizit zu explizit

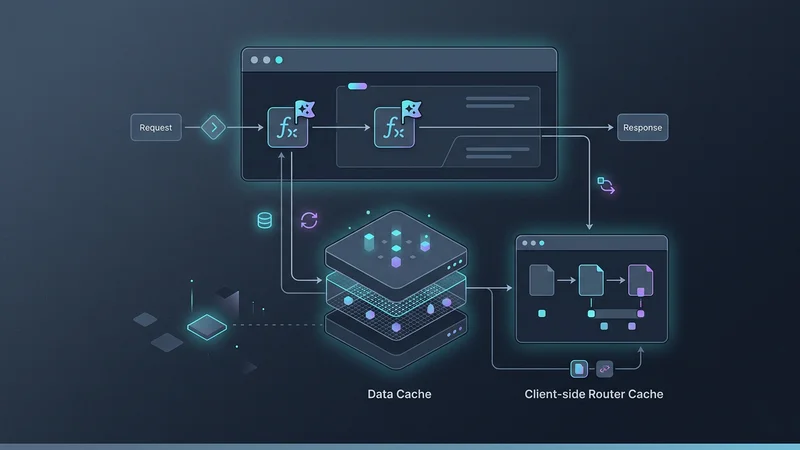

In früheren Versionen des App Routers war das Caching oft „implizit“. Ein einzelner Aufruf einer dynamischen Funktion wie cookies() oder headers() konnte unerwartet eine gesamte Route vom Caching ausschließen. Next.js 16 hat dies mit dem „Cache Components“-Modell grundlegend geändert.

Die use cache-Direktive

Die use cache-Direktive ist der bedeutendste Fortschritt in Next.js 16. Sie ermöglicht es Entwicklern, Caching explizit auf Funktions- oder Dateiebene zu aktivieren. Dies beendet die Unvorhersehbarkeit des vorherigen Caching-Modells.

- Caching auf Funktionsebene: Sie können nun spezifische Logik (wie eine Datenbankabfrage oder einen externen API-Aufruf) in eine async-Funktion kapseln und mit

'use cache';markieren. Next.js wird den Rückgabewert basierend auf den serialisierten Argumenten cachen. - Caching auf Dateiebene: Wenn Sie

'use cache';am Anfang einer Datei platzieren, wird jede exportierte Funktion innerhalb dieser Datei gecacht.

// services/products.ts

import { unstable_cacheLife as cacheLife } from 'next/cache';

export async function getProductDetails(productId: string) {

'use cache'; // Explizites Opt-in für das Caching dieser Funktion

cacheLife('minutes'); // Definieren des Ablaufprofils

const res = await fetch(`https://api.acme.com/products/${productId}`);

if (!res.ok) throw new Error('Failed to fetch product');

return res.json();

}Granulare Cache-Control APIs

Um dieses explizite Modell zu unterstützen, hat Next.js mehrere neue APIs für das Cache-Management eingeführt:

cacheLife: Ersetzt die älterenrevalidate-Konstanten. Es akzeptiert Profile wie'minutes','hours'oder'days', was die Verwaltung der TTL (Time To Live) über verschiedene Umgebungen hinweg erleichtert.cacheTagundrevalidateTag: Diese bleiben der Goldstandard für die On-Demand-Invalidierung. Durch das Taggen eines gecachten Segments können Sie dieses sofort löschen, wenn sich Daten ändern (z. B. nach einem CMS-Webhook).

Rendering-Patterns meistern: PPR und Streaming

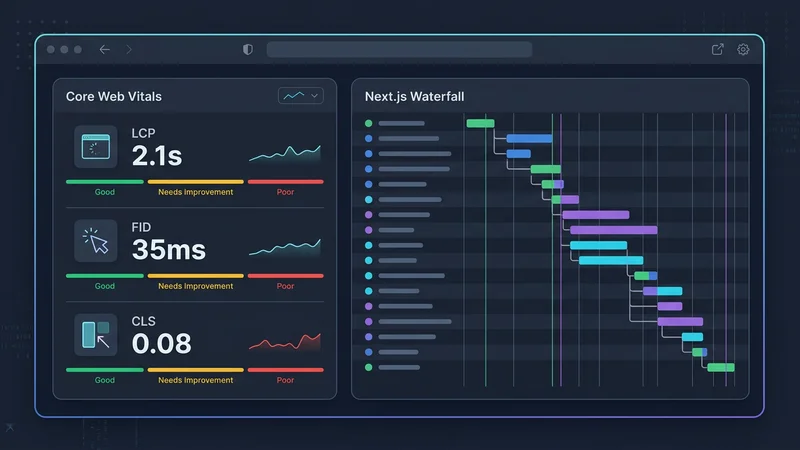

Das Ziel der Performance-Optimierung ist die Reduzierung der Time to First Byte (TTFB) und der Interaction to Next Paint (INP). Next.js 16 erreicht dies durch die Stabilisierung von Partial Prerendering (PPR).

Stabiles Partial Prerendering (PPR)

PPR ermöglicht es Ihnen, statisches und dynamisches Rendering auf derselben Seite ohne Konfigurationsaufwand zu kombinieren. Wenn ein Benutzer eine Seite anfordert, liefert Next.js sofort ein statisches HTML-Gerüst (Shell), das Ihr Layout, die Navigation und statische Inhalte enthält. Die „dynamischen Lücken“ (Holes) – Teile der Seite, die benutzerspezifische Daten erfordern – werden in <Suspense>-Grenzen eingeschlossen und gestreamt, sobald sie aufgelöst sind.

Um PPR zu aktivieren, konfigurieren Sie es in Ihrer next.config.js:

// next.config.js

const nextConfig = {

experimental: {

ppr: 'incremental', // PPR schrittweise für Ihre Routen einführen

},

};

module.exports = nextConfig;Die Rolle von React 19 und dem React Compiler

Next.js 16 nutzt den stabilen React Compiler. Zuvor verbrachten Entwickler viel Zeit damit, Komponenten manuell mit useMemo, useCallback und React.memo zu optimieren, um unnötige Re-Renders zu vermeiden. Der React Compiler automatisiert diesen Prozess, indem er Ihren Code analysiert und Memoisierung dort anwendet, wo sie den größten Nutzen bringt.

Dies resultiert in:

- Weniger Arbeit für den Main-Thread: Komponenten rendern nur dann neu, wenn sich ihre tatsächlichen Datenabhängigkeiten ändern.

- Verbesserte INP: Durch die Reduzierung der Arbeit, die React während Updates verrichtet, bleibt der Browser reaktionsfähig auf Benutzereingaben.

Strategien für hochperformantes Data Fetching

Data Fetching ist oft der primäre Flaschenhals in Webanwendungen. Im App Router müssen wir uns von sequentiellen „Wasserfällen“ (Waterfalls) weg und hin zu paralleler Ausführung und Streaming bewegen.

Request-Waterfalls eliminieren

Ein häufiger Fehler ist das Abwarten mehrerer Fetch-Aufrufe nacheinander. Dies zwingt die zweite Anfrage, auf den Abschluss der ersten zu warten, was die Latenz verdoppelt.

Das Anti-Pattern (Langsam):

const user = await getUser(); // Benötigt 500ms

const posts = await getPosts(user.id); // Benötigt 500ms (Gesamt: 1000ms)Das optimierte Pattern (Schnell):

// Beide Anfragen parallel initiieren

const userPromise = getUser();

const postsPromise = getPosts();

// Warten, bis beide aufgelöst sind

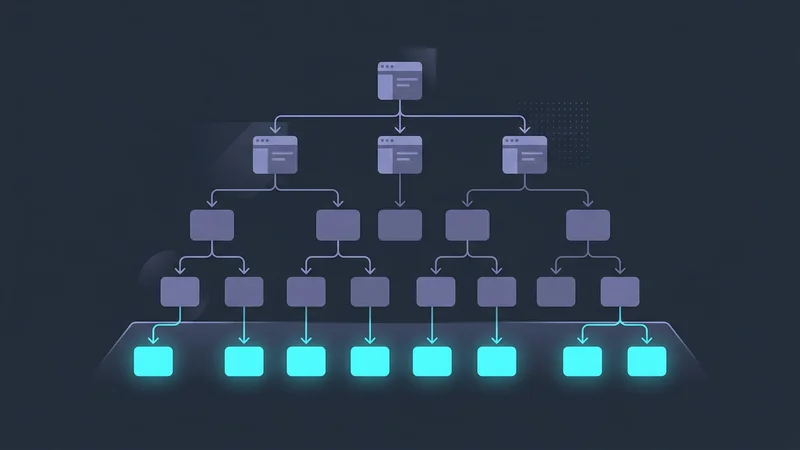

const [user, posts] = await Promise.all([userPromise, postsPromise]);Nutzung von Server Components für „Leaf“-Optimierung

Um das an den Client gesendete JavaScript-Bundle zu minimieren, sollten Sie Ihre „Client Components“ an den Blättern (Leaves) Ihres Komponentenzweigs halten. Wenn Sie ein übergeordnetes Layout als "use client" markieren, wird jede in dieses Layout importierte Komponente Teil des Client-Bundles.

Übergeben Sie stattdessen Server Components als Children oder Props an Client Components, um den „Server-First“-Vorteil zu erhalten.

// Schlecht: Die gesamte Seite ist eine Client Component

"use client"

export default function Dashboard({ data }) {

return <Sidebar>{/* komplexe Logik */}</Sidebar>;

}

// Gut: Nur der interaktive Toggle ist eine Client Component

export default function DashboardPage() {

return (

<Sidebar>

<Suspense fallback={<Skeleton />}>

<DataList /> {/* Server Component */}

</Suspense>

<InteractiveToggle /> {/* Client Component */}

</Sidebar>

);

}

Asset-Optimierung und der Wechsel zu Turbopack

Assets – Bilder, Schriftarten und Skripte – machen oft den größten Teil des Gewichts einer Seite aus. Next.js bietet integrierte Primitive, um diese automatisch zu handhaben.

Bildoptimierung mit next/image

Die next/image-Komponente ist mehr als nur ein <img>-Tag. Im Jahr 2025 ist es unerlässlich, das priority-Attribut für Largest Contentful Paint (LCP) Elemente und das sizes-Attribut zu verwenden, um zu verhindern, dass der Browser Bilder herunterlädt, die zu groß für den Viewport sind.

<Image

src="/hero.jpg"

alt="Hero Image"

width={1200}

height={600}

priority // Essenziell für LCP

sizes="(max-width: 768px) 100vw, (max-width: 1200px) 50vw, 33vw"

/>Schriftoptimierung und Zero Layout Shift

Die Verwendung von next/font ermöglicht es Ihnen, Schriftarten lokal zu hosten und verwaltet automatisch die font-display-Eigenschaft. Dies eliminiert Layout-Shifts (CLS), die durch das Laden von Schriftarten nach dem initialen Rendering verursacht werden. Durch die Verwendung von CSS-Variablen mit next/font können Sie sicherstellen, dass Ihre Typografie bereit ist, sobald das HTML geparst wird.

Turbopack: Der neue Standard

Da Turbopack nun der Standard-Bundler in Next.js 16 ist, haben sich die Build-Zeiten und die Geschwindigkeiten für Fast Refresh drastisch verbessert. Turbopack verwendet eine in Rust geschriebene inkrementelle Berechnungs-Engine, die nur den exakten Code neu kompiliert, der sich geändert hat. Für große Anwendungen kann dies die Produktions-Build-Zeiten um bis zu 80 % reduzieren.

Monitoring und Validierung in der Praxis

Performance-Optimierung ist keine Aufgabe nach dem Motto „Einrichten und vergessen“. Sie müssen Ihre Verbesserungen mittels Real User Monitoring (RUM) validieren.

- Vercel Speed Insights: Dieses Tool bietet ein Live-Dashboard der Core Web Vitals (LCP, INP, CLS) Ihrer Anwendung basierend auf tatsächlichen Benutzerdaten.

- Sentry und OpenTelemetry: Für tiefere Einblicke, insbesondere in Server Components und API-Routen, verwenden Sie OpenTelemetry-basiertes Tracing. Dies ermöglicht es Ihnen zu sehen, welche Datenbankabfrage oder welcher externe API-Aufruf Ihr Server Side Rendering (SSR) verlangsamt.

- Zod für Laufzeitsicherheit: Obwohl es kein direktes „Geschwindigkeits-Tool“ ist, stellt die Verwendung von Zod zur Validierung von API-Antworten sicher, dass Ihre Anwendung nicht aufgrund unerwarteter Datenstrukturen abstürzt oder hängen bleibt, was zu einer schlechten gefühlten Performance führen kann.

Häufig gestellte Fragen

Wie optimiere ich die Performance im Next.js App Router?

Die Optimierung im App Router konzentriert sich auf die standardmäßige Verwendung von Server Components, um Client-seitiges JavaScript zu reduzieren, und die Implementierung von Partial Prerendering (PPR) für schnelle initiale Ladezeiten. Nutzen Sie zusätzlich die use cache-Direktive für granulares Daten-Caching und stellen Sie sicher, dass Sie next/image und next/font zur Asset-Optimierung verwenden.

Ist der Next.js App Router schneller als der Pages Router?

Der App Router ist in der Regel schneller, da er React Server Components (RSC) ermöglicht, was die Menge an an den Browser gesendetem JavaScript erheblich reduziert. Er unterstützt auch fortschrittliche Funktionen wie Streaming und Partial Prerendering, die im Pages Router nicht verfügbar sind, was zu besseren Core Web Vitals führt.

Wie reduziere ich die JavaScript-Bundle-Größe in Next.js?

Um die Bundle-Größe zu reduzieren, verschieben Sie Interaktivität an die „Blätter“ Ihres Komponentenbaums und verwenden Sie dynamische Importe (next/dynamic) für schwere Drittanbieter-Bibliotheken. Vermeiden Sie es, die "use client"-Direktive auf der obersten Ebene Ihrer Layouts zu platzieren, da dies alle Kindkomponenten in das Client-seitige Bundle zwingt.

Wie funktioniert das Caching im Next.js App Router?

In Next.js 16 erfolgt das Caching explizit über die use cache-Direktive, die es Ihnen ermöglicht, Funktionen oder Dateien mit spezifischen TTL-Profilen mittels cacheLife zu cachen. Es nutzt zudem ein mehrstufiges Caching-System, einschließlich Request Memoization, Data Cache und Full Route Cache, um redundante Verarbeitung zu minimieren.

Was sind die Best Practices für Data Fetching in Next.js?

Rufen Sie Daten immer auf dem Server mittels Server Components ab, um die Logik nah an der Datenquelle zu halten und den Client-seitigen Overhead zu reduzieren. Verwenden Sie paralleles Fetching mit Promise.all, um Wasserfälle zu vermeiden, und umschließen Sie langsame Datenabfragen mit <Suspense>-Grenzen, um Streaming für eine bessere Benutzererfahrung zu ermöglichen.

Fazit

Die Optimierung der Performance im Next.js App Router ist ein Weg hin zu expliziter Kontrolle. Indem Sie die use cache-Direktive nutzen, Partial Prerendering einsetzen und dem React Compiler die Low-Level-Optimierungen überlassen, können Sie Anwendungen erstellen, die nicht nur schnell, sondern auch belastbar und wartbar sind.

Wenn wir auf die Zukunft des Webs in den Jahren 2025 und 2026 blicken, hat sich der Fokus von „wie viel können wir an den Client senden“ zu „wie wenig benötigen wir tatsächlich“ verschoben. Indem Sie diesen Best Practices folgen, stellen Sie sicher, dass Ihre Next.js-Anwendungen an der Spitze in Bezug auf Geschwindigkeit und Benutzererfahrung bleiben.